【ITBEAR科技资讯】9月3日消息,近日有关于开源编程语言Triton以及OpenAI的重要发展引起了广泛关注。Triton被誉为一种类似于Python的编程语言,旨在让研究人员能够更轻松地编写高效的GPU代码,即使没有CUDA经验也能取得优异的性能。该语言最初仅支持英伟达GPU,但最新的Triton版本却在GitHub上暴露了对AMD ROCm的适配,预示着其将不再局限于英伟达平台。

根据OpenAI的介绍,Triton仅需25行代码,即可在FP16矩阵乘法上达到与cuBLAS相当的性能,极大地简化了GPU加速的编程过程。据称,即使是初学者也能编写出与专业人士相媲美的代码,通过相对较少的努力,实现最高的硬件性能。

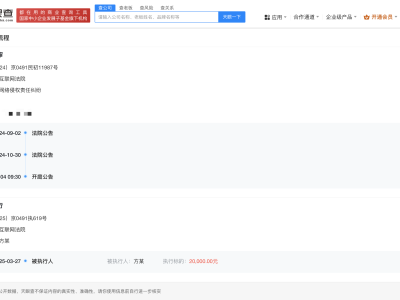

近期,OpenAI宣布将于9月20日在加利福尼亚州山景城的微软硅谷园区举办Triton开发者大会。会议的日程安排中包括将Triton引入AMD GPU和Triton的英特尔XPU等重要议题。这一举措标志着Triton逐步摆脱了英伟达CUDA的垄断,为更多硬件平台的集成提供了可能性。

据ITBEAR科技资讯了解,Triton的开源特性使得其他硬件加速器能够直接集成到其中,从而大大减少了为新硬件建立AI编译器栈的时间。此外,在PyTorch 2.0版本中,TorchInductor已经引入了对OpenAI Triton的支持,这使得在多个加速器和后端生成快速代码成为可能,同时使用Python替代CUDA编程来编写底层硬件代码,为深度学习研究者带来了更大的便利。