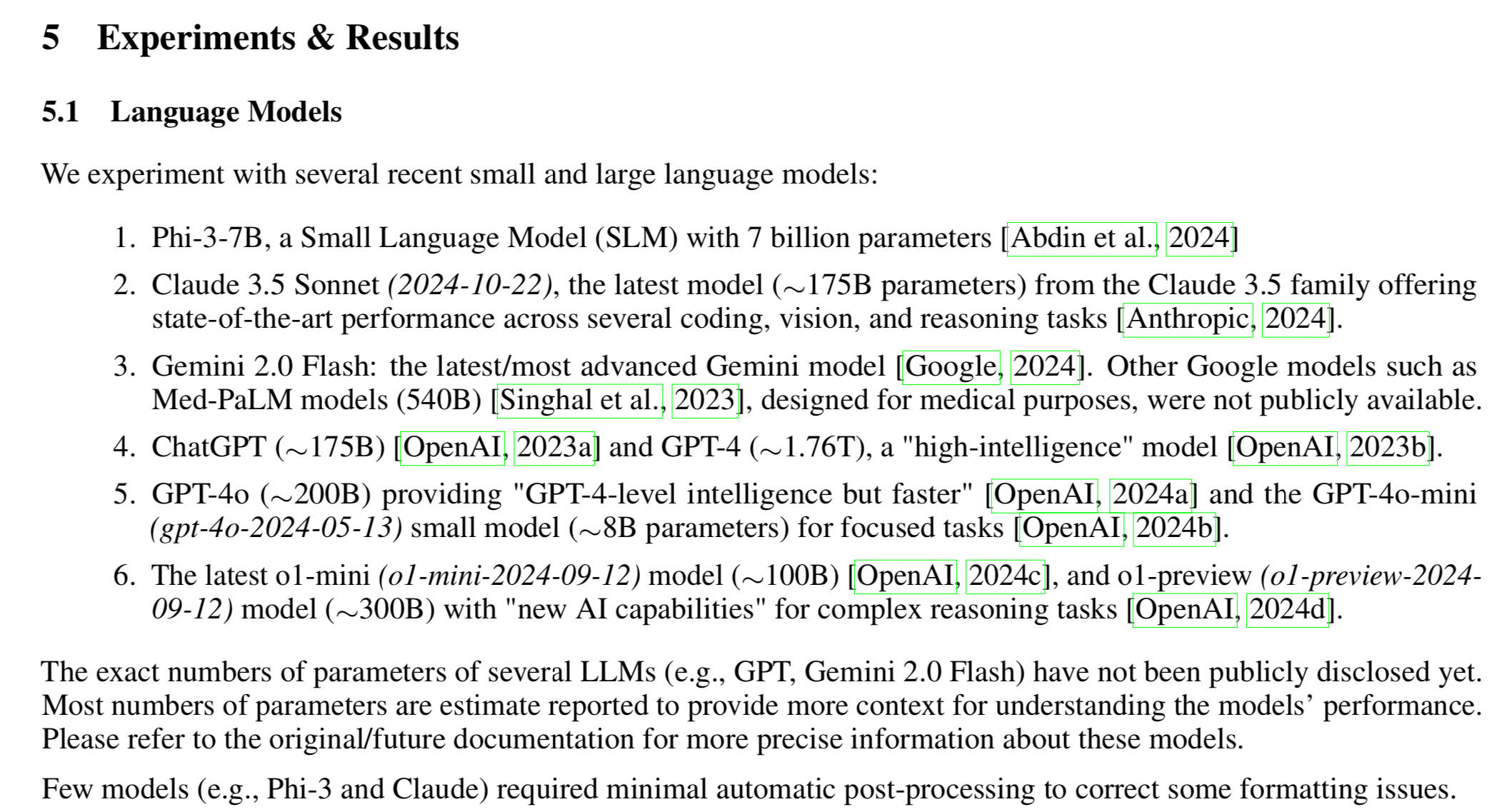

近日,一篇来自微软与华盛顿大学合作的医疗领域研究论文,不经意间揭示了OpenAi系列人工智能模型的详细参数配置,引起了业界的广泛关注。

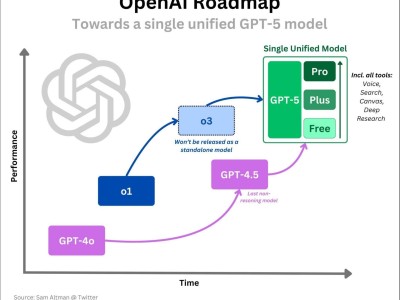

论文中提及,备受期待的GPT-4模型拥有惊人的1.76万亿参数,这一数字彰显了其在处理复杂语言和理解任务上的强大潜力。而与之相比,GPT-4o系列的参数规模则显得更为精简,其基础版本参数量约为2000亿,即便是更为轻量级的mini版,也达到了80亿参数,这一设计或意味着OpenAi在追求高效能与资源利用上迈出了新的一步。

论文还披露了其他几个型号的参数信息:o1-preview版本拥有约3000亿参数,而它的mini版本则缩减至约1000亿;另一款名为Claude 3.5 Sonnet的模型,其参数量也达到了约1750亿的水平。这些信息不仅为研究人员提供了宝贵的参考,也让公众对OpenAi的技术进展有了更深入的了解。

值得注意的是,GPT-4o系列参数量的相对减少,尤其是mini版仅有80亿参数,这一策略可能旨在满足更多对计算资源有限制的应用场景需求,同时也展示了OpenAi在模型优化和压缩技术上的最新成果。这种轻量级模型的开发,有望在保持高性能的同时,降低运行成本,拓宽AI技术的应用范围。