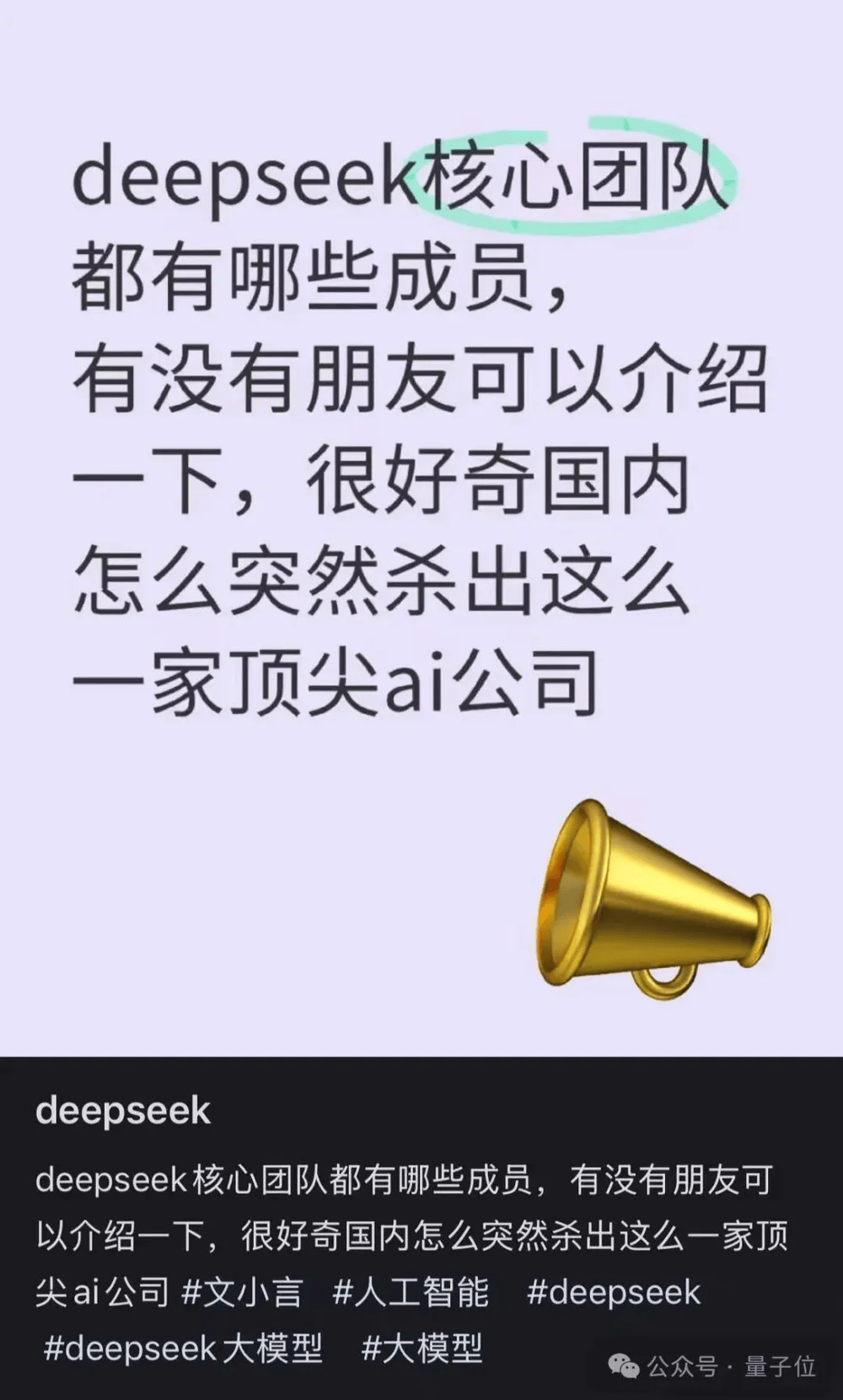

在人工智能领域,一支年轻的团队正以惊人的速度崛起,他们的名字叫做DeepSeek。近期,DeepSeek发布的DeepSeek-v3大模型,以仅为Llama 3 405B模型1/11的算力,实现了超越前者的性能,这一成就迅速在AI圈内引起了轰动。

随着DeepSeek-v3的发布,关于该团队的各种传闻也随之而来,其中最为引人注目的是“雷军开出千万年薪挖角DeepSeek研究员罗福莉”的消息。这一传闻不仅让科技圈沸腾,更让全网都对这支神秘的团队充满了好奇。

DeepSeek究竟有何魅力?为何能吸引如此多的关注?从各种资料中,我们可以发现,这支团队的最大特点就是年轻和充满活力。团队成员中,应届生、在读生占据了相当大的比例,特别是来自清华大学和北京大学的应届生,更是团队中的佼佼者。

在这些年轻的面孔中,不乏已经在学术界崭露头角的佼佼者。例如,有的成员在DeepSeek搞研究的同时,其博士学位论文还获得了奖项的认可。他们中的一些人,从DeepSeek LLM v1开始,就参与了团队的工作,一直到现在,已经成为了团队中的中坚力量。

DeepSeek的核心成员中,高华佐和曾旺丁是MLA架构的关键创新者。MLA(Multi-head Latent Attention)是DeepSeek-V2中的一项重要创新,它大幅减少了计算量和推理显存,为DeepSeek-V2的成功奠定了坚实的基础。而曾旺丁,则来自北京邮电大学,其导师是北邮人工智能与网络搜索教研中心主任张洪刚。

除了MLA,DeepSeek-V2还涉及到了另一项关键成果——GRPO。GRPO是PPO的一种变体RL算法,它显著减少了训练资源的需求,受到了业内的广泛关注。这一成果的背后,也有着年轻研究员的辛勤付出。邵智宏、朱琪豪和Peiyi Wang等核心作者,在DeepSeek实习期间就完成了这一工作。

邵智宏是清华大学交互式人工智能(CoAI)课题组博士生,师从黄民烈教授。他的研究领域包括自然语言处理和深度学习,对构建一个稳健且可扩展的AI系统有着浓厚的兴趣。朱琪豪则是北京大学计算机学院软件研究所的博士毕业生,他的研究方向是深度代码学习,曾发表多篇CCF-A类论文。

DeepSeek的创始人梁文锋,在团队的建设上有着独到的见解。他强调,团队的核心技术岗位主要以应届和毕业一两年的人为主,看能力而不是看经验。这一理念贯穿了整个团队的招聘和人才培养过程,使得团队能够吸引并留住大量的年轻才俊。

除了团队成员的年轻化,DeepSeek在国内AI公司中还有着另一个突出的特点:非常重视模型算法和硬件工程的配合。在DeepSeek-v3的论文中,有200位作者参与了这一工作,他们不仅负责AI算法和数据,还参与了硬件的优化和算力的提升。

这种软硬件协同的设计,使得DeepSeek能够以极低的算力实现高性能的大模型训练。而这一切的背后,离不开团队中那些既懂算法又懂硬件的年轻工程师们的辛勤付出。

DeepSeek的运作模式也让人想起了另一家AI界的巨头——OpenAI。同样不看经验、重用新人,同样面对潜力方向时从顶层开始设计布局和资源推动。或许,在未来的某一天,DeepSeek会成为组织形态上最像OpenAI的中国AI公司。