在人工智能领域,一场关于深度推理模型的技术竞赛正在悄然升温。1月20日晚,两家国内AI企业——月之暗面(Kimi)和深度求索(DeepSeek)几乎同时发布了最新研发的深度推理模型,均声称其性能可与OpenAI的“满血版”o1相媲美,并公开了相关的技术报告。

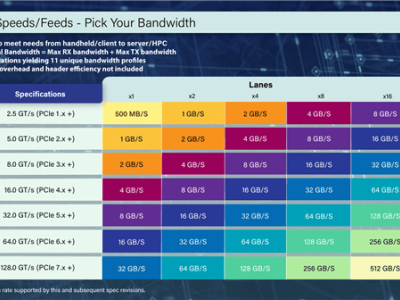

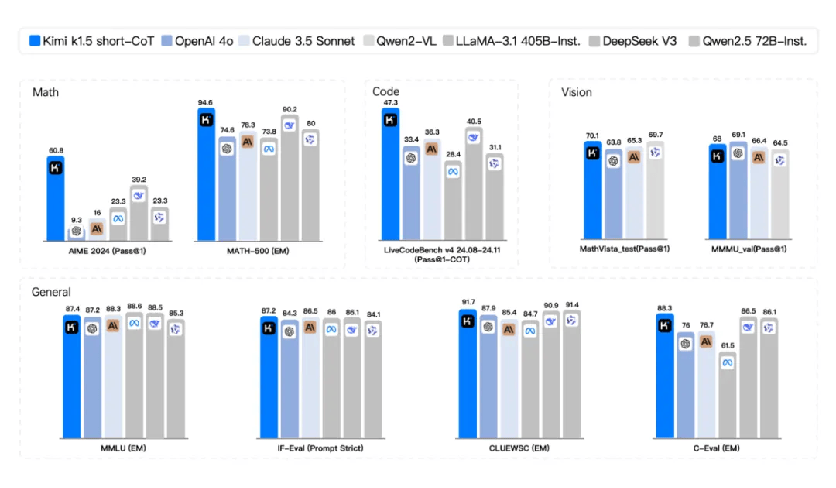

月之暗面此次推出的k1.5多模态思考模型,标志着该公司在推理模型上的又一重要突破。据技术报告显示,在short-CoT(短思维链)模式下,k1.5在数学、代码、视觉多模态和通用能力方面,超越了GPT-4o和Claude 3.5 Sonnet等模型。同时,在多个基准测试中,k1.5也超过了通义、DeepSeek、Llama等国内外领先的开源模型。

而在long-CoT(长思维链)模式下,k1.5的数学、代码、多模态推理能力更是达到了OpenAI o1正式版的水平,仅在编码和视觉能力的部分测试中稍逊一筹。同一天,DeepSeek也发布了其开源推理模型DeepSeek-R1,该模型同样在数学、代码、自然语言推理等任务上展现了与o1正式版相当的性能。

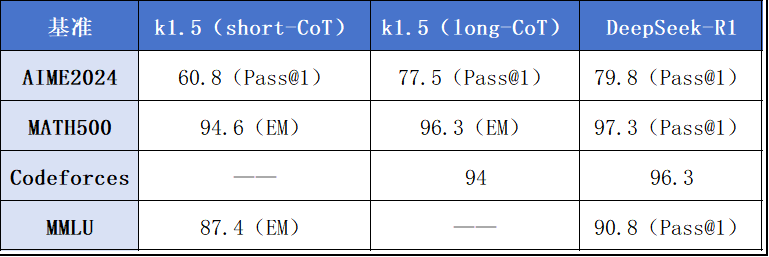

两款模型的对标表现引发了业界的广泛关注。搜狐科技在对比两款模型的基准测试结果后发现,在数学能力方面,Kimi的k1.5在AIME2024和MATH500两个主流基准测试中略逊于DeepSeek-R1。同时,在代码基准Codeforces以及多任务语言理解MMLU测试中,k1.5也未能超越DeepSeek-R1。然而,值得注意的是,DeepSeek-R1目前尚不具备视觉等多模态能力。

尽管在部分测试中稍逊一筹,但DeepSeek-R1的开源策略以及极低的价格却赢得了不少开发者的青睐。DeepSeek宣布,其模型将完全开源,不限制商用,并允许用户利用模型输出进行蒸馏等方式训练其他模型。DeepSeek-R1的API定价也远低于o1,为用户提供了更为经济实惠的选择。

DeepSeek-R1的开源策略不仅赢得了开发者的认可,也引发了业界的热议。英伟达高级研究科学家Jim Fan对DeepSeek表示了赞赏,认为其是第一个展示强化学习飞轮效应且持续增长的开源项目。Jim Fan还提到,DeepSeek的模型完全由强化学习驱动,没有任何监督微调,这是论文中最重要的收获之一。

事实上,无论是Kimi的k1.5还是DeepSeek的R1,其性能的提升都离不开强化学习的力量。两款模型的技术论文均强调了强化学习在模型训练中的重要作用。通过强化学习,模型能够在没有人工干预的情况下进行自我进化,从而不断提升其推理能力。

随着Kimi和DeepSeek的加入,国内AI企业在深度推理模型领域的竞争也愈发激烈。科大讯飞、商汤、智谱、MiniMax、阶跃星辰等多家AI企业也先后推出了强调推理性能的模型。与此同时,谷歌等国际巨头也在紧追OpenAI,不断推出新的大模型技术。可以预见的是,未来的AI领域将是一场关于技术、创新和应用的全面竞争。