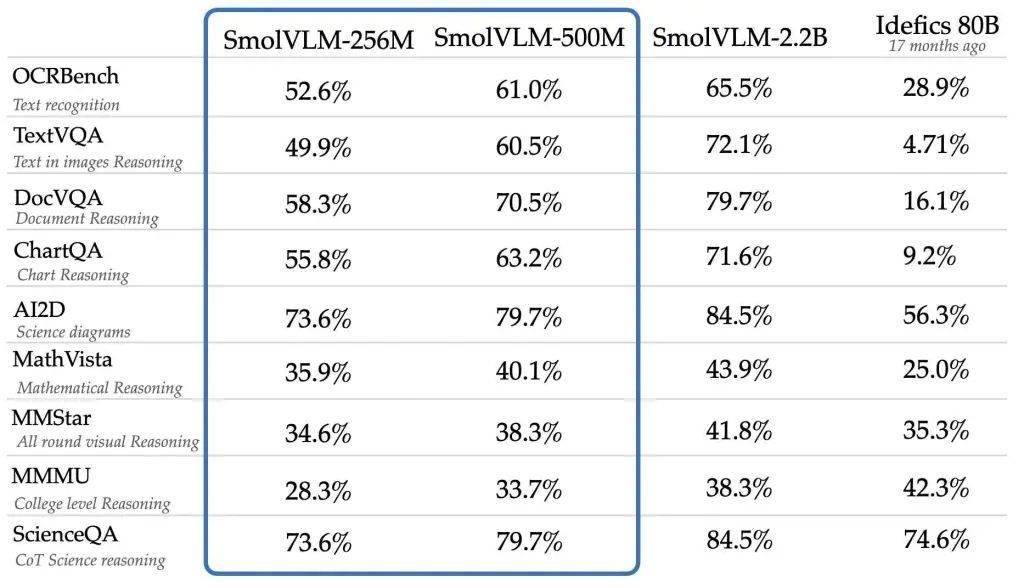

Hugging Face平台近日宣布了一项重大进展,推出了两款专为算力受限设备设计的轻量级AI模型——SmolVLM-256M-Instruct与SmolVLM-500M-Instruct。这两款模型的问世,标志着在资源有限的环境下,AI性能发挥将迈入新阶段。

早在去年11月,Hugging Face就已推出了仅有20亿参数的SmolVLM AI视觉语言模型,该模型因其极低的内存占用而在同类产品中表现突出,特别适用于设备端推理。而此次推出的新版本,则在参数数量上进行了进一步优化。

SmolVLM-256M-Instruct,作为目前发布的最小视觉语言模型,其参数量仅为2.56亿。令人惊叹的是,这款模型甚至能在内存低于1GB的PC上流畅运行,同时提供出色的性能表现。这无疑为那些拥有有限硬件资源的用户和开发者打开了全新的可能性。

另一款模型SmolVLM-500M-Instruct,则拥有5亿参数。它主要针对硬件资源受限的场景设计,旨在帮助开发者应对大规模数据分析的挑战,实现AI处理效率和可访问性的双重突破。这两款模型的推出,无疑将进一步提升Hugging Face在AI领域的竞争力。

SmolVLM系列模型具备先进的多模态能力,能够执行包括图像描述、短视频分析以及回答关于PDF或科学图表问题在内的多项任务。Hugging Face解释称,SmolVLM在构建可搜索数据库时速度更快、成本更低,其性能甚至可媲美规模远超其自身的模型。

为了开发这些模型,Hugging Face采用了两个专有数据集:The Cauldron和Docmatix。The Cauldron是一个包含50个高质量图像和文本数据集的精选集合,专注于多模态学习。而Docmatix则专为文档理解而设计,通过将扫描文件与详细标题配对,以增强模型的理解能力。

在模型架构方面,SmolVLM-256M-Instruct和SmolVLM-500M-Instruct采用了更小的视觉编码器SigLIP base patch-16/512,而非SmolVLM 2B中使用的更大版本SigLIP 400M SO。这一优化减少了冗余,提高了模型处理复杂数据的能力,并优化了图像标记的处理方式。

SmolVLM系列模型能够以每个标记4096像素的速率对图像进行编码,这一性能相较于早期版本中的每标记1820像素有了显著提升。这一改进将进一步增强模型在图像处理和理解方面的能力。