近日,AI领域迎来重大突破,DeepSeek开源大模型的横空出世,犹如一股强劲的风暴,席卷了整个行业。各大技术平台迅速响应,积极寻求与DeepSeek的适配合作,其中,国产GPU厂商壁仞科技的表现尤为亮眼。

壁仞科技凭借自主研发的壁砺系列GPU产品,在极短的时间内便成功完成了对DeepSeek R1全系列蒸馏模型的支持。这一壮举不仅覆盖了从1.5B到70B各个参数等级的版本,还囊括了LLaMA蒸馏模型和千问蒸馏模型,充分展现了壁砺系列GPU在AI领域的强大兼容性和高效性能。

壁仞科技因此成为少数能够实现国际、国内多模型同步高效适配的芯片平台之一,这标志着国产芯片在应对复杂AI应用任务时,已经具备了与国际领先产品相媲美的能力。

DeepSeek所提供的模型蒸馏技术,无疑为AI行业的发展注入了新的活力。该技术能够将大规模模型的能力迁移到更小、更高效的版本中,同时通过MLA和DeepSeek MoE两大核心技术,大幅降低显存占用,优化模型性能。壁仞科技能够迅速适配DeepSeek全系列蒸馏模型,正是得益于其在AI推理任务中的强大兼容性和易用性。

为了进一步深化与DeepSeek的合作,壁仞科技已携手上海智能算力、中兴通讯、科华数据等多家战略伙伴,基于壁砺系列训推产品,全面开展DeepSeek全系列模型的适配与上线工作。这一举措将满足不同规模参数量模型的部署需求,为AI行业的发展注入更多动力。

针对不同规模的模型,壁仞科技也给出了相应的应用场景和解决方案。轻量级模型(1.5B-8B)适用于智能终端与边缘计算设备,可实现低延时实时推理;中大规模模型(14B-32B)则服务于大规模企业级应用和高并发任务,满足数据安全与定制化需求;而大规模模型(70B)则依托云端超算集群,支撑前沿AI研究与复杂任务处理。

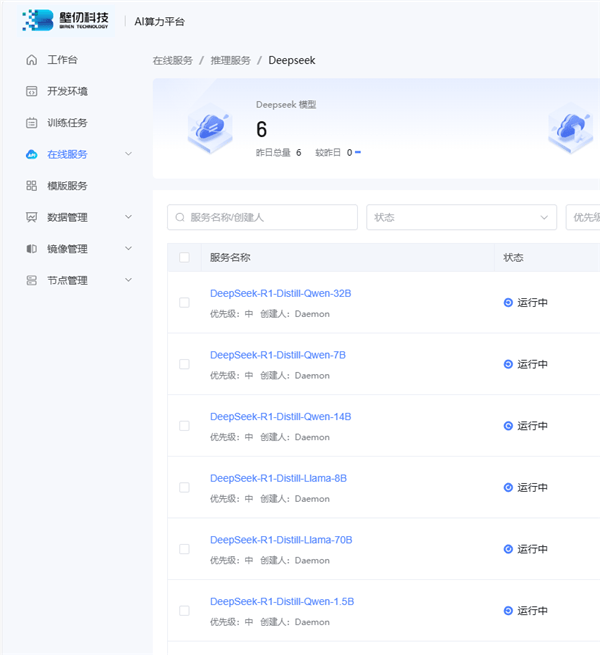

壁仞AI算力平台现已正式上线DeepSeek R1蒸馏模型推理服务。全球开发者只需通过云端,即可体验1.5B、7B、8B、14B、32B、70B全系列模型服务。这一服务不仅免去了硬件采购与环境搭建的繁琐过程,实现了“开箱即用”的云端推理体验,还针对不同任务预置了优化配置方案,覆盖了多场景应用。

壁仞科技的这一系列举措,无疑为AI行业的发展注入了新的活力。随着DeepSeek开源大模型的广泛应用和壁仞科技等国产GPU厂商的崛起,我们有理由相信,AI行业的未来将更加精彩纷呈。