在人工智能领域,一场由DeepSeek引领的变革正在悄然发生,这家中国初创企业凭借其惊人的效率革命,不仅震撼了全球AI从业者,也让科技巨头们纷纷调整战略。DeepSeek的开发成本极低,其开源与服务完全免费的特点,让包括世界首富马斯克在内的众多业界人士为之惊叹,甚至让知名投资人“木头姐”凯茜·伍德直言,DeepSeek加剧了人工智能的成本崩溃。

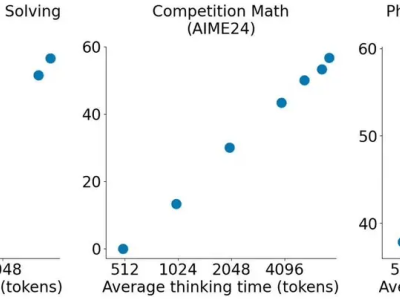

DeepSeek的颠覆性创新在于其极致的效率。在1月20日正式发布的DeepSeek-R1模型系列中,该模型在Chatbot Arena大模型排行榜上的基准测试排名迅速攀升至全类别第三,与ChatGPT-4o最新版并驾齐驱,并在风格控制类模型分类中夺得头名。而令人震惊的是,DeepSeek-R1模型的训练成本仅为OpenAI GPT-4o模型的十分之一左右。据DeepSeekV3技术报告,V3模型的训练总计仅需要278.8万GPU小时,成本仅557.6万美金。

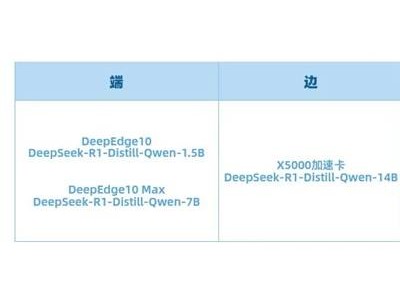

这种成本优势源于DeepSeek自研的MLA和MOE架构,以及数据蒸馏技术的运用。通过一系列算法和策略,DeepSeek能够将原始复杂的数据进行去噪、降维、提炼,得到更为精炼、有用的数据,从而提升训练效率。这种“四两拨千斤”的能力,让DeepSeek在AI领域实现了从“高投入、高算力”到“低成本、高效率”的转变。

DeepSeek的出现,打破了AI领域长期遵循的Scaling Law(模型规模定律)。该定律认为,模型性能与规模(参数量、数据大小、算力资源)呈正相关。然而,DeepSeek用实际成果证明,通过模型架构和工程优化的创新,可以在不盲目追求大规模算力投入的情况下,实现AI性能的提升。这一发现,无疑给正在狂热进行算力投资的科技大厂们泼了一盆冷水。

面对DeepSeek带来的挑战,科技巨头们纷纷调整策略。OpenAI紧急上线了新一代推理模型o3系列的mini版本,并首次免费向用户开放其基础功能。字节跳动、微软、谷歌等科技巨头,也在加大对AI领域的投入,但开始更加注重效率优化和模型架构设计。

然而,DeepSeek的出现并不意味着算力建设可以彻底放弃。相反,随着AI技术的不断发展,算力需求仍然将持续增长。尤其是在中国,算力基础设施仍处于初步搭建阶段,远未到过剩状态。国家已将算力建设纳入国家级战略,加快形成全国一体化算力体系。目前,中国算力基础设施规模占全球的26%,名列第二。未来,随着“东数西算”等数字基础设施工程的积极推进,中国算力规模将进一步扩大。

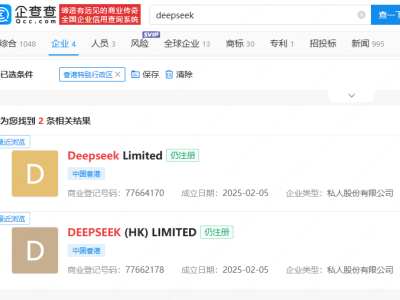

尽管如此,DeepSeek带来的“范式转移”仍然对AI领域产生了深远影响。它不仅破除了科技大厂建立的技术领先壁垒,还打破了重资本比拼的游戏惯例。DeepSeek的开源和免费策略,更是让全球科技界看到了中国智慧和创新的力量。在全球AI领域的拉锯战中,中国企业以DeepSeek为代表,开始以一种领先或颠覆者的身份出现,让世界为之侧目。

然而,我们也应看到,中美AI领域的竞争仍然激烈。在保持冷静和谦逊的心态的同时,我们应继续加大在算力基础设施和AI技术创新方面的投入,以应对未来的挑战和机遇。DeepSeek的成功经验告诉我们,通过创新方法和高效策略,我们可以在AI领域实现弯道超车,为全球科技界贡献更多的中国智慧和力量。

在这场AI领域的变革中,DeepSeek无疑是一个重要的里程碑。它不仅让全球科技界看到了中国企业的创新实力,更为AI领域的未来发展指明了新的方向。我们期待在未来的日子里,能够看到更多的中国企业像DeepSeek一样,以创新和智慧引领全球科技潮流。