近日,AI领域再次迎来了一场风波,这次的主角是一个名为s1的人工智能推理模型。据媒体报道,斯坦福大学和华盛顿大学的研究人员,包括知名学者李飞飞,以惊人的低成本——不到50美元的云计算费用,成功训练出了这一模型。该模型在数学和编码能力测试中,展现出了与OpenAI的O1和DeepSeek的R1等尖端推理模型相匹敌的实力。

然而,这一消息在AI圈内引发了广泛的讨论和质疑。有观点认为,s1模型的成功并非完全从零开始,而是建立在其他强大模型的基础之上。为了深入了解s1模型的真相,我们查阅了相关的研究论文。

论文摘要中明确提到,s1模型的训练采用了测试时间缩放技术,这是一种利用额外测试时计算资源来提高性能的新方法。研究人员通过精心整理了一个包含1000个问题的小数据集s1K,并对一个现成的预训练模型进行了有监督微调。这个预训练模型就是阿里云的通义千问Qwen2.5-32B-Instruct。研究人员还开发了一种名为“预算强制”的方法,通过控制测试时的计算量来优化模型性能。

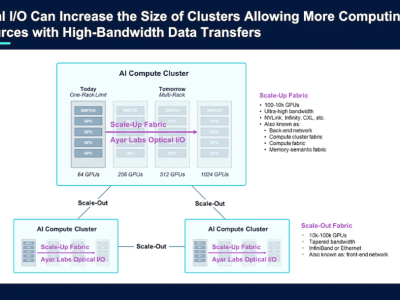

具体来说,s1K数据集的1000个问题都配有从谷歌的Gemini Thinking Experimental提炼出的推理过程和答案。研究人员在这个小数据集上对Qwen2.5-32B-Instruct进行了有监督微调,并在16个H100 GPU上仅需训练26分钟。训练完成后,他们使用“预算强制”方法来控制模型在测试时花费的计算量,从而提高了模型的推理性能。

论文还提到,s1模型在竞赛数学问题上的表现甚至超过了OpenAI的o1-preview模型,准确率提高了27%。这一成果无疑展示了s1模型在推理能力上的强大实力。然而,值得注意的是,s1模型的成功并非完全依赖于其自身的创新,而是站在了其他强大模型的肩膀上。

关于“不到50美元”的成本,论文中并未直接提及。但据财联社报道,这一费用仅为云计算服务费用,不包括服务器、显卡等硬件投入费用。这或许解释了为何能够以如此低的成本训练出如此强大的模型。

对于s1模型的这一成就,DeepSeek团队也给出了自己的看法。他们认为,s1模型的成功可能由多种技术和管理因素驱动,包括模型架构创新、训练策略突破以及硬件利用革新等。同时,他们也提到了蒸馏监督微调作为一种有效的模型训练方法,在模型压缩、迁移学习和提升模型性能方面具有显著优势。

事实上,蒸馏监督微调在AI领域并不罕见。许多主流大模型都采用了这种方法来优化性能。例如,DeepSeek-R1模型就使用了强化学习和大规模数据蒸馏技术。这也证明了蒸馏在模型训练中的重要性。

阿里云也证实了李飞飞团队以阿里通义千问Qwen2.5-32B-Instruct开源模型为底座,训练出了新模型s1-32B。这一成果不仅展示了s1模型在推理能力上的强大,也为未来的研究提供了一定的方向。

然而,尽管s1模型取得了显著的成就,但我们也需要清醒地认识到,蒸馏毕竟是建立在强大开源模型的基础之上,并非小模型自身能力的体现。因此,“50美元复刻DeepSeek”这样的标题,或许有些过于夸张了。

尽管如此,s1模型的成功仍然为AI领域带来了新的启示。它告诉我们,通过合理利用现有资源和技术,我们可以在低成本的情况下实现高性能的AI模型。这对于推动AI技术的普及和应用具有重要意义。

同时,s1模型的成功也引发了人们对于AI未来发展的思考。随着技术的不断进步和创新,或许会有更多基于算法创新的低成本模型出现。这将为AI领域带来更多的可能性和机遇。

最后,我们也期待未来能够有更多关于s1模型和其他AI技术的深入研究和实践应用,为人类社会的发展贡献更多的智慧和力量。