近期,DeepSeek这款应用因其出色的功能而备受用户追捧,然而,由于服务器承载压力巨大,时常出现无响应的情况。为了获得更流畅的体验,越来越多的用户开始倾向于本地部署,而这种部署方式的具体效果则取决于个人的硬件配置。

AMD在x86处理器领域一直走在前列,并率先将AI能力引入其中。锐龙7040系列处理器就集成了独立的NPU AI引擎,而后续的锐龙8040系列、锐龙AI 300系列以及锐龙AI MAX 300系列,在AI性能上更是不断攀升。

AMD锐龙AI处理器所搭载的NPU,目前处于行业领先地位,其算力高达每秒50万亿次,即50 TOPS,这样的性能使得它成为体验DeepSeek的理想选择。

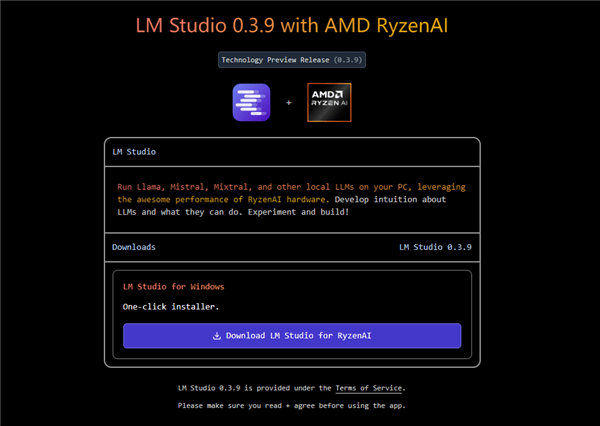

对于那些已经拥有锐龙AI笔记本的用户来说,通过LM Studio平台,他们可以轻松地在本地部署并体验DeepSeek R1精简版推理模型。以下是具体的操作步骤:

首先,需要安装AMD Adrenalin 25.1.1或更新版本的显卡驱动。然后,访问lmstudio.ai/ryzenai,下载LM Studio 0.3.8或更新版本,并进行安装。在安装完成后,可以直接跳过引导屏幕,进入软件主界面。

接下来,点击“发现”标签页,选择适合自己的DeepSeek R1 Distill版本。具体选择依据个人需求而定。在软件页面右侧,勾选“Q4 K M”量化模式,并点击“下载”按钮。下载完成后,返回聊天选项页,从下拉菜单中选择已下载的DeepSeek R1 distill版本,并确保勾选“手动选择参数”选项。

在“GPU卸载”设置中,将滑块移至最大值,以优化性能。最后,点击“模型加载”按钮,即可在本地体验DeepSeek R1推理模型。

不同规模的参数模型,其性能和体积也各不相同,因此,用户需要根据自己的硬件设备选择最适合的参数量。例如,顶级配置的锐龙AI MAX+ 395处理器,搭配64GB或128GB内存,最高可以支持DeepSeek-R1-Distill-Llama-70B模型。若内存为64GB,则需将可变显存设置为高。而搭配32GB内存,并将可变显存自定义为24GB,则可支持DeepSeek-R1-Distill-Qwen-32B模型。

对于锐龙AI HX 370和AI 365处理器,搭配24GB或32GB内存,可以支持DeepSeek-R1-Distill-Qwen-14B模型。而锐龙7040/8040系列,则需搭配32GB内存,才能支持到同一模型。AMD还建议将所有Distill运行在Q4 K M量化模式下,以获得最佳性能。

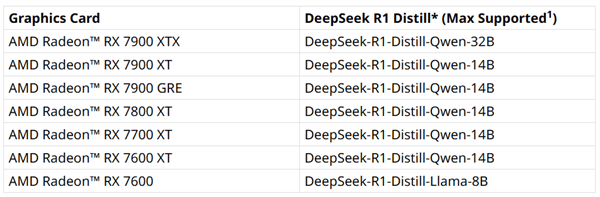

对于台式机用户,AMD RX 7000系列显卡也已支持本地部署DeepSeek R1。其中,RX 7900 XTX旗舰显卡最高可支持DeepSeek-R1-Distill-Qwen-32B模型,而RX 7900 XT、7900 GRE、7800 XT、7700 XT以及7600 XT均可支持到DeepSeek-R1-Distill-Qwen-14B模型。对于RX 7600以及新发布的RX 7650 GRE显卡,则更适合运行DeepSeek-R1-Distill-Llama-8B模型。