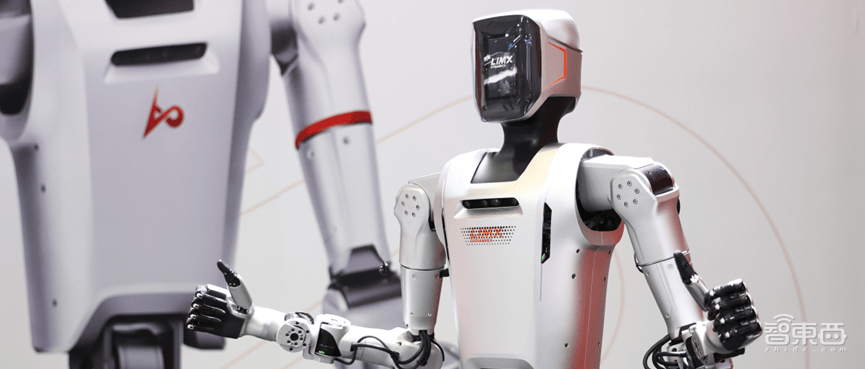

在机器人技术的前沿探索中,逐际动力近期宣布了一项重大突破:成功研发出基于视频生成大模型的具身操作算法LimX VGM。这一创新技术标志着国内首次将人类操作数据直接转化为机器人操作能力的实现。

长久以来,具身智能领域一直面临数据应用的难题。尽管人类操作视频丰富多样,但这些视频数据却难以直接应用于机器人操作。尽管大型模型能够根据视频生成行为轨迹和操作数据,但往往存在精度不足、偏离物理规律等问题,使得这些数据在实际应用中受到限制。

逐际动力的LimX VGM算法通过对人类操作视频数据进行后训练,成功解决了这一难题。该算法仅需场景图片和操作任务指令作为提示,即可实现任务的理解与拆分、物体操作轨迹的生成,以及最终的机器人操作执行。整个过程无需任何真实机器人的样本数据,且具备跨平台泛化的能力。

LimX VGM的工作流程包括三个关键步骤:在训练阶段,算法通过采集真实人类操作的视频数据,对现有视频生成大模型进行后训练;在推理阶段,算法结合初始场景和任务操作指令,生成带深度信息的人类操作视频,并据此生成机器人的操作行为;在执行阶段,算法输出符合机器人操作逻辑的行为解算,由机器人执行相应的操作轨迹。

LimX VGM的创新不仅在于其工作流程,更在于其背后的三大核心技术突破。首先,该算法通过有效训练从现有大模型框架中提取关键信息,转化为机器人操作策略及行为,从而实现了人类操作视频到机器人操作策略的桥接。这一过程大大简化了数据采集工作,降低了成本,提高了效率。

其次,LimX VGM引入了空间智能模块,突破了2D生成视频的局限。在视频生成大模型的后训练过程中,算法通过深度相机捕捉人手真实操作过程,引入深度信息,使生成的操作视频直接包含三维空间数据。这一创新为机器人在物理空间中的操作提供了关键支持。

最后,LimX VGM实现了算法与机器人本体的解耦,使得算法可以跨平台部署。整个训练过程仅依赖人类操作视频,不涉及任何机器人本体。因此,算法的真机部署仅需简单适配,即可实现跨硬件平台的直接操作执行。这一特性使得LimX VGM在面对不断推陈出新的机器人硬件时,无需大幅调整算法或重新采集数据,实现了操作能力的设备泛化。

在演示中,研究人员展示了LimX VGM算法在三种构型、参数、能力等方面差异巨大的机械臂上的应用效果。尽管这些机械臂在诸多方面存在显著差异,但算法仍然能够实现一致的操作效果,充分展示了其跨平台部署和泛化能力。