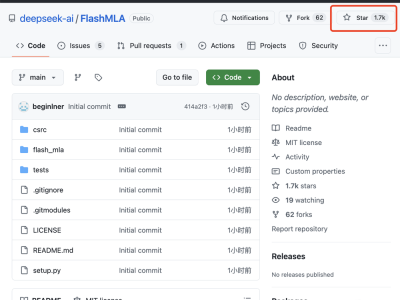

在AI领域的一次重大开源活动中,DeepSeek开源周的首日便迎来了令人瞩目的更新。其首个开源代码库FlashMLA一经发布,便在GitHub上迅速获得了超过1700个Star,展现了业界的高度关注与期待。

FlashMLA是DeepSeek为Hopper GPU量身定制的高效MLA解码内核,特别针对可变长度序列进行了优化,并已投入实际应用。此次发布的版本包含了BF16格式的支持,以及一个块大小为64的分页键值缓存(kvcache),进一步提升了性能。

据DeepSeek介绍,在使用CUDA 12.6的H800 SXM5上,FlashMLA展现出了卓越的性能指标。其内存带宽高达3000 GB/s,确保了数据的快速访问和传输;同时,计算性能达到了580 TFLOPS,为AI工作负载提供了强大的计算能力。这样的优化,使得FlashMLA能够在高性能硬件上高效处理大语言模型和其他AI应用的密集计算需求。

FlashMLA的发布引起了广泛的关注和讨论。在DeepSeek的推文发布不到一小时的时间内,就吸引了超过10万人的关注和上百条评论。海外开发者们纷纷表示对FlashMLA的兴趣和赞赏,有人甚至感叹这是“纯粹的工程,太爱了!”同时,也有英伟达股民在评论区留言,希望DeepSeek能在不影响英伟达股价的前提下,进一步提升GPU的效率。

不仅如此,DeepSeek的评论区还出现了拉踩OpenAI的现象。有网友甚至建议OpenAI将域名无偿捐赠给DeepSeek,以表达对其开源贡献的认可。而更多的海外网友则迫不及待地催促DeepSeek发布更多的开源产品,有人期待语音模式的研发,也有人猜测第五天发布的开源产品可能是AGI。

随着DeepSeek开源周的持续进行,业界对后续发布的四个代码库也充满了期待。这些代码库可能会涉及AI算法优化、模型轻量化、应用场景拓展等多个关键领域,为AI领域的发展注入新的活力。DeepSeek的开源贡献无疑将推动AI技术的进一步发展和普及,向所有开源者致敬。