近期,北京大学肖睿团队分享了两份关于DeepSeek的“内部秘籍”,引起了广泛关注。此前,清华大学发布的五部DeepSeek攻略已经激起了不少人对这一领域的兴趣。对于初学者来说,DeepSeek仍然是一个神秘而强大的工具。

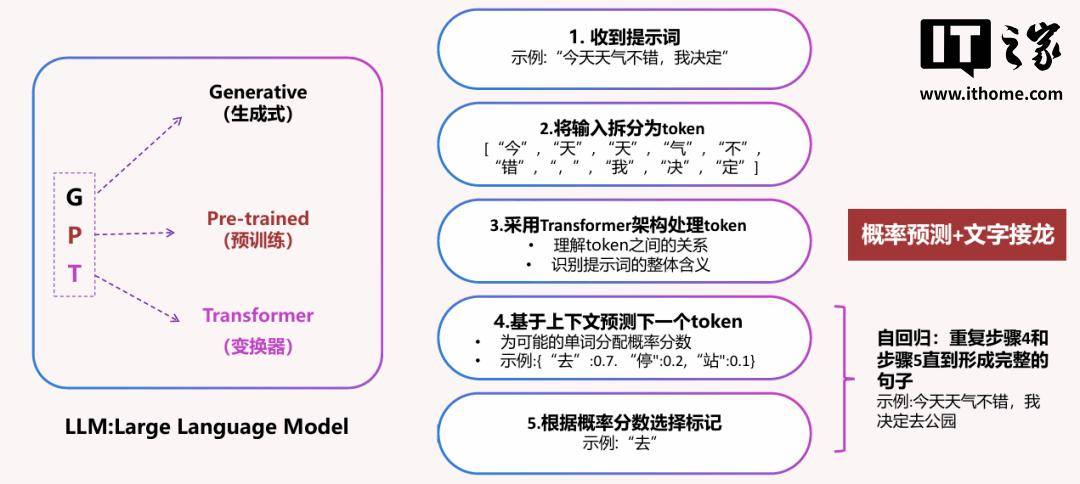

首先,我们需要从基础开始理解。DeepSeek作为大语言模型的一员,其运作机制与我们常听到的GPT有着异曲同工之妙。GPT,即生成式预训练变换器(Generative Pre-trained Transformer),它的工作流程颇为直观:接收提示词,将输入内容拆分为一个个token,通过Transformer架构处理这些token,基于上下文预测下一个token,并根据概率分数选择最合适的token,如此自回归地重复,直至形成完整的句子。

这种机制赋予了GPT及其同类模型强大的语言理解和生成能力,以及一定程度的世界知识和推理能力。然而,它们也并非无所不能,存在着AI幻觉、知识库有限及上下文窗口限制等劣势。

肖睿团队的秘籍之一《DeepSeek与AIGC应用》正是为非专业背景的读者揭开DeepSeek的神秘面纱。它详细解释了DeepSeek是什么,以及它能在哪些场景中发挥作用。在使用这些AI大模型时,我们需时刻注意其能力边界。例如,GPT-3.5和GPT-4的上下文长度有限,处理长文本时需分段对话、定期总结,使用关键词提醒等技巧。

在文本分析领域,大模型擅长统计、摘要生成等任务,但在面对知识更新、语境歧义等复杂情况时,其表现可能不尽如人意。面对新词汇、语境误判等问题,大模型也会无奈地表示:“这我都没训练过啊!”

了解这些基础后,我们便能更深入地理解AIGC工具的应用场景。目前,面向普通用户的AIGC工具主要包括聊天对话机器人、图像生成工具、音频工具、视频生成工具和搜索工具等。DeepSeek-R1以其强大的推理能力脱颖而出,但它不具备多模态能力,无法处理图像、音频等信息。相比之下,豆包等多模态能力更强的工具更适合日常休闲对话。

肖睿团队的另一份秘籍《DeepSeek提示词工程和落地场景》则专注于DeepSeek R1的使用技巧。作为一款CoT思维链模型,我们需要改变传统的提示词习惯,更直接地与AI沟通我们的需求。例如,可以告诉AI:“我要(做)XX,要给XX用,希望达到XX效果,但担心XX问题。”还可以通过“反向PUA”的方式,引导AI通过自身的思考逻辑输出更好的结果。

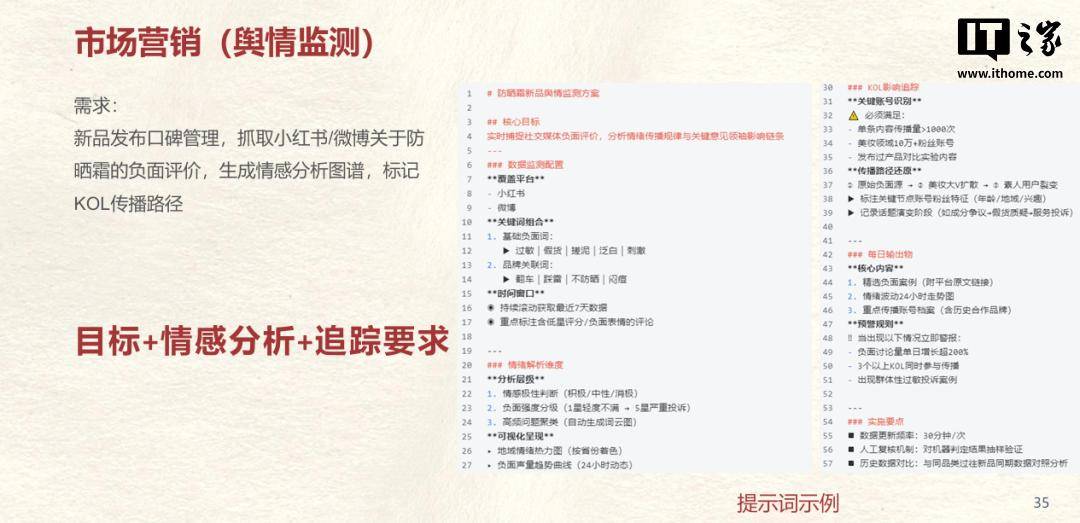

这份秘籍还提供了市场营销、公文写作、编程开发、数据分析、会议纪要、学术研究等多个领域的用法示例,为读者提供了丰富的实践指导。