在近期举办的“2025年GDC全球开发者先锋大会”上,一场聚焦医疗领域人工智能发展的论坛——《AI焕新,塑医疗未来》吸引了众多业界精英的目光。其中,深信服AI研发部总经理时文涛的演讲尤为引人注目,他以《模塑医疗,共WiN-AI》为题,分享了医疗大模型在实际应用中的挑战与机遇。

时文涛指出,尽管医疗大模型具备强大的潜力,但在实际应用中却面临着“用不起”、“不会用”和“用不好”的难题。他强调,大模型不应仅仅被视为一种工具或能力,而应更多地关注其在实际业务流程中的应用。为此,深信服携手卫宁健康,共同推出了WiN-AI卫信云这一创新的一体化交付解决方案。

WiN-AI卫信云以“线上线下一朵云”为架构基础,通过线下智算升级与线上能力订阅的方式,为医疗用户提供从模型训练到推理加速再到应用创新的全方位服务。这一方案不仅内置了通用与专用双模型,还配备了AI算力调度平台、算力资源以及卫宁健康的两大AI应用——医疗大语言模型WiNGPT 2.8和人工智能医护助手WiNEX Copilot 2.1版本。

在模型管理方面,深信服AICP算力平台展现出了极高的灵活性和开放性。它能够有效管理各种开源基模型和版本,以及客户的私有模型,确保用户能够随时获取最新的模型更新,并进行二次微调与训练、推理部署等操作。这一平台不仅简化了模型管理的复杂性,还确保了技术的持续进化和无限可能。

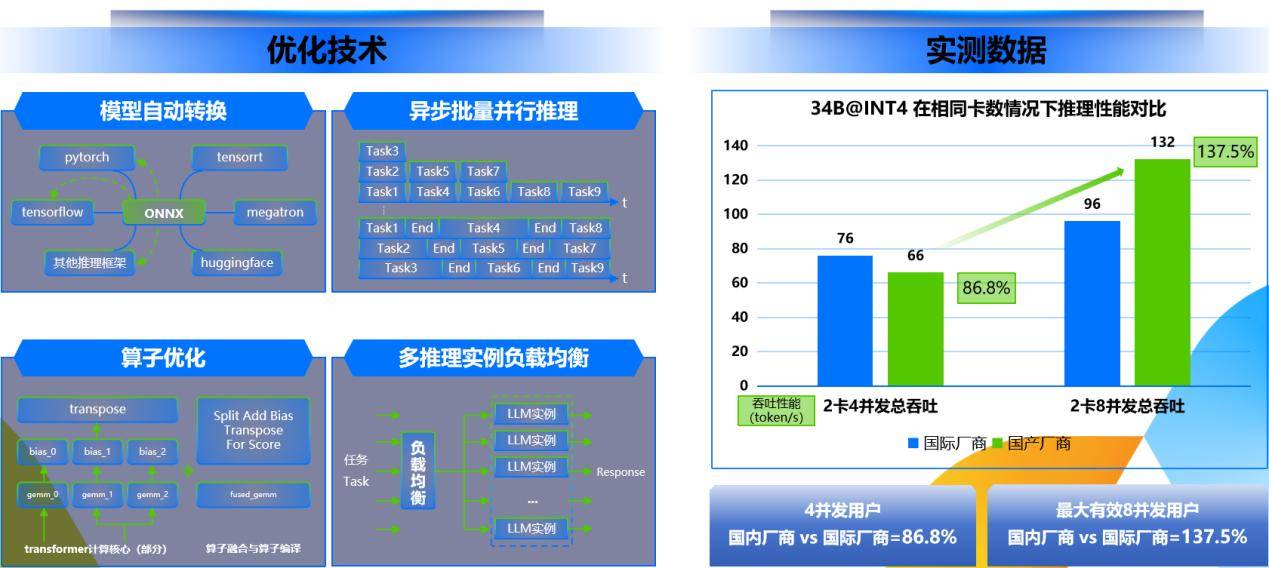

在推理性能方面,深信服同样进行了全面优化。通过AICP算力平台的部署方案,WiN-AI卫信云在多实例、并发推理场景中实现了显著的性能提升。这使得AI加持下的WiN-AI卫信云能够为用户提供更加流畅的使用体验,同时降低资源投入成本。

具体而言,WiN-AI卫信云内嵌了推理优化模型,并通过算力资源的精准调度,实现了最大推理GPU成本下降75%,资源利用率达到了行业前沿水平。在32B模型64并发场景下,相较开源方案(如Ollama),WiN-AI卫信云的问答吞吐量提升了10倍,长文本处理稳定性也提升了300%。

在保障模型知识产权和安全方面,深信服采用了模型动态加密技术。通过结构加密、权重加密和算子加密等方式,对模型结构进行混淆加密,从而保护模型运行态的安全。同时,自适应加密算法能够根据不同模型自适应调整和组合不同强度的加密技术,确保模型安全的同时,也保障了部署的可行性和推理性能。

深信服还与国内多家GPU厂商进行了深度合作,通过软硬协同优化,实现了对标国际厂商的推理性能。在承载相同大模型的情况下,经过软硬协同优化后的国产卡性价比显著高于国际厂商,性能对比结果达到了137.5%。

回顾过去,深信服与卫宁健康的合作可以追溯到2020年。当时,双方正式发布了联合打造的一体化解决方案,播下了“卫信云”的种子。随着业务需求的不断迭代和技术的不断进步,这颗种子在创新的沃土中茁壮成长,最终演化为全新升级的WiN-AI卫信云。这一创新成果不仅为医疗行业注入了智能化新动能,也展现了深信服与卫宁健康在科技浪潮中的默契协作与深度融合。