在机器人技术的前沿探索中,一款名为智元启元大模型Genie Operator-1(简称GO-1)的创新产品近日由智元机器人公司正式发布。这一发布标志着通用具身基座模型技术迈出了重要一步,为机器人智能化发展开辟了新路径。

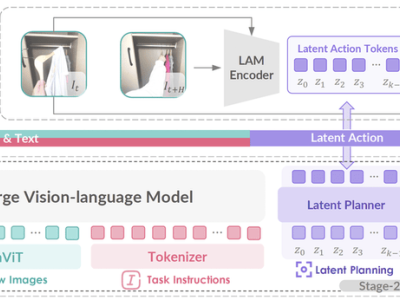

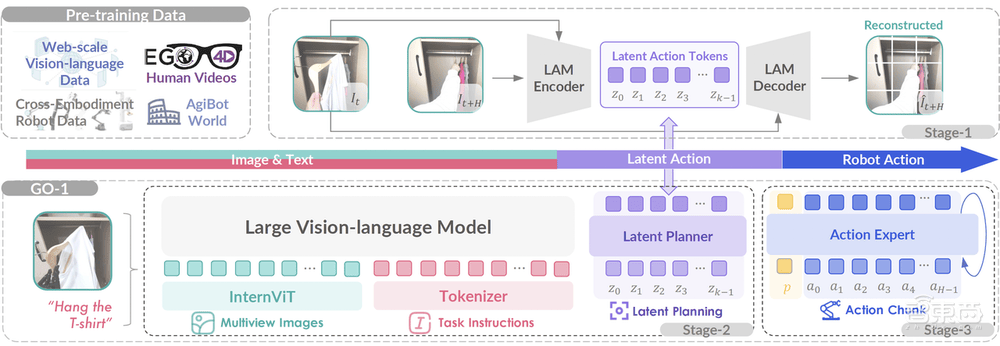

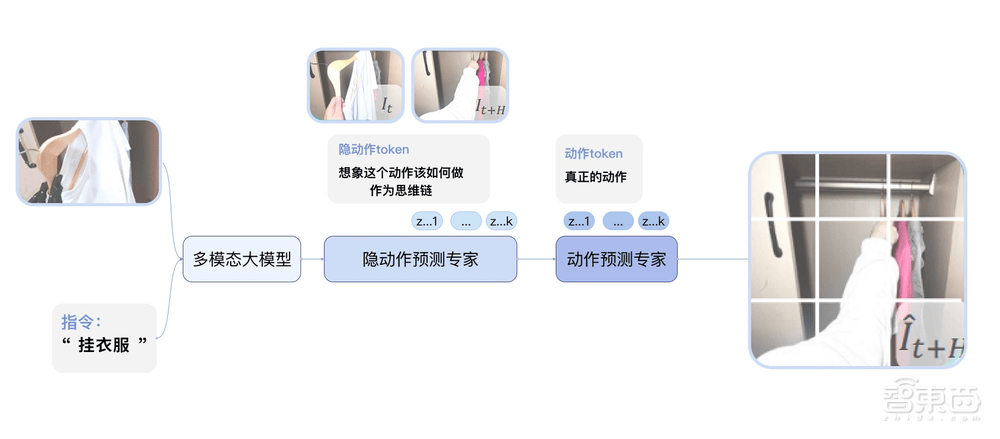

GO-1的核心在于其独特的Vision-Language-Latent-Action(ViLLA)框架,该框架融合了VLM(多模态大模型)与MoE(混合专家)技术。这一组合不仅实现了数据采集、模型训练与推理的一体化流程,还赋予了GO-1小样本快速泛化的能力,使其能够迅速适应各种新场景和新任务。

GO-1的VLM部分基于开源多模态大模型的权重,通过大规模互联网纯文本和图文数据的训练,获得了广泛的场景感知和理解能力。而MoE中的隐动作专家模型和动作专家模型,则分别利用互联网上的操作视频和高质量的仿真、真机数据,实现了对动作的理解和精细执行。

智元机器人强调,GO-1的“一脑多形”特性使其能够在不同机器人形态间灵活迁移,快速适配各类本体。通过智元的数据回流系统,GO-1能够持续进化,从实际执行中遇到的问题数据中学习,不断提升性能。

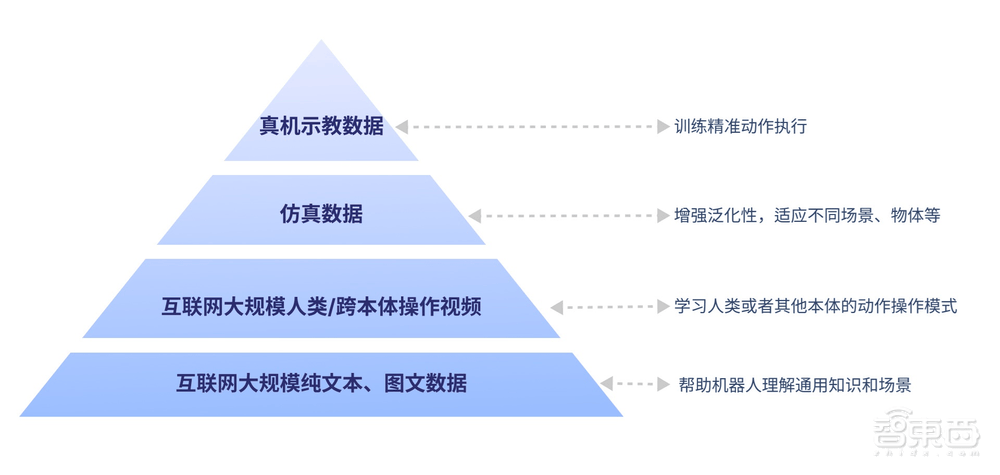

GO-1的构建基于具身领域的数字金字塔模型,从底层的大规模纯文本与图文数据,到人类操作视频、仿真数据,再到顶层的真机示教数据,形成了一个完整的知识和技能学习体系。这一体系使得GO-1能够轻松应对多样化的环境和物体,快速学习新的操作。

在实际应用中,用户只需通过简单的语言指令,GO-1就能根据输入的视觉信号和语言指令,直接输出机器人的动作执行。例如,用户告诉机器人“挂衣服”,GO-1就能理解指令含义,通过已学习的操作模式和仿真数据,精准完成挂衣服的任务。

智元机器人还展示了GO-1在多种场景中的应用。从家庭场景中的准备餐食、收拾桌面,到办公和商业场景中的接待访客、发放物品,GO-1都能迅速响应并完成任务。GO-1还能通过数据回流持续进化,不断优化其性能。

GO-1的成功发布,标志着具身智能技术向通用化、开放化与智能化迈出了重要一步。它不仅解决了传统具身智能面临的场景和物体泛化能力不足、语言理解能力欠缺等问题,还为机器人走向更多不同场景、适应多变的真实世界提供了可能。