在机器人技术领域的最新突破中,智元机器人公司近日震撼发布了其首个通用具身基座模型——智元启元大模型Genie Operator-1(简称GO-1)。这一创新成果不仅标志着机器人在理解和执行人类指令方面迈出了重要一步,还预示着具身智能正加速向通用化、开放化与智能化转型。

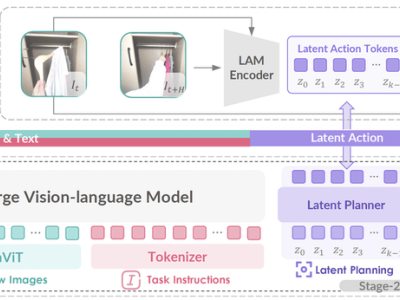

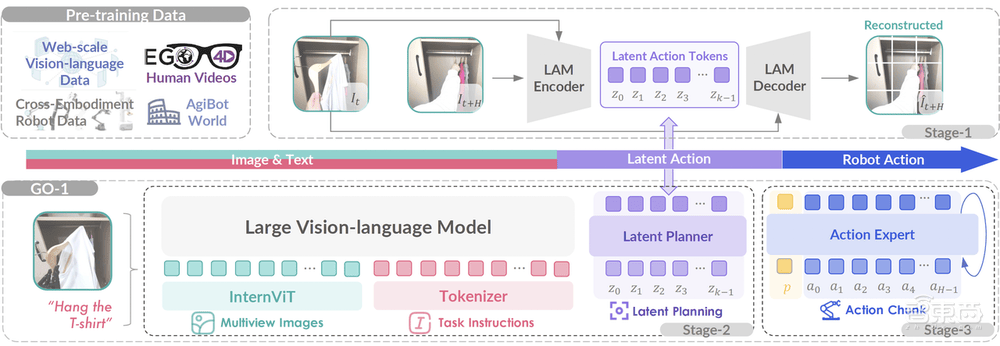

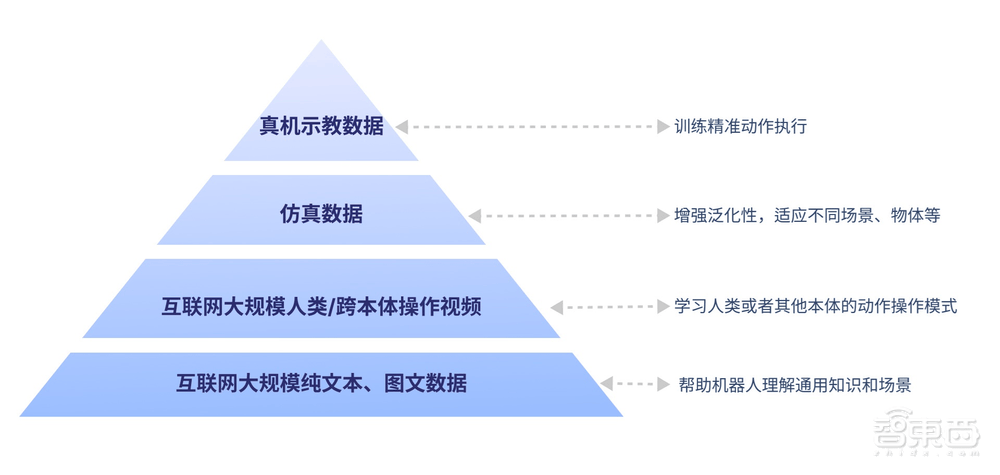

GO-1的核心在于其提出的Vision-Language-Latent-Action(ViLLA)框架,该框架巧妙融合了VLM(多模态大模型)与MoE(混合专家)技术。VLM作为主干网络,继承了开源多模态大模型的权重,并通过互联网大规模纯文本和图文数据的训练,赋予了GO-1强大的场景感知和理解能力。而MoE则进一步增强了模型的动作规划和执行能力,使其能够精准响应各种指令。

智元机器人公司强调,GO-1具备小样本快速泛化的能力,这意味着它能够在极少数据甚至零样本的情况下,快速适应新场景和新任务。这一特性极大地降低了后训练成本,使得GO-1能够迅速应用于各种实际场景中。

GO-1的“一脑多形”特性使其成为一个真正的通用机器人策略模型。它能够在不同机器人形态之间灵活迁移,快速适配到各种本体上,从而大大拓展了其应用范围。智元公司还透露,未来几个月将推出基于强化学习的仿真模型,并即将亮相新的人形机器人,这将进一步推动具身智能的发展。

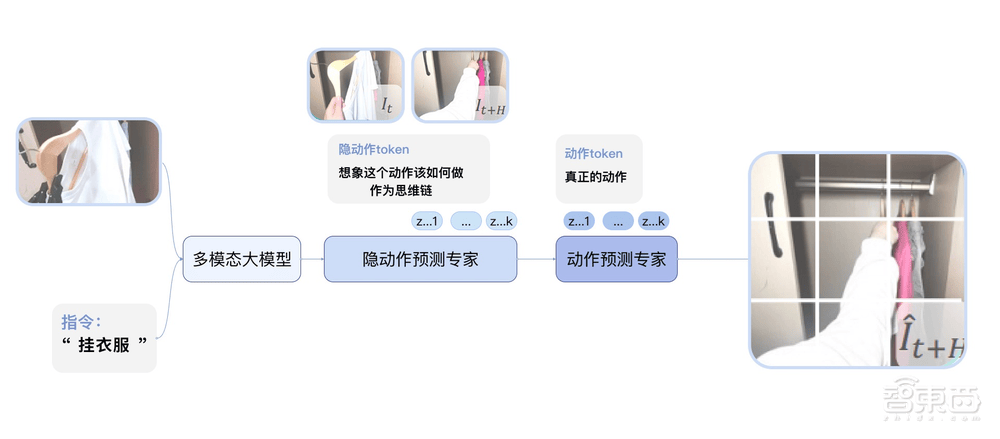

GO-1的ViLLA框架通过预测隐式动作标记(Latent Action Tokens),成功弥合了图像-文本输入与机器人执行动作之间的鸿沟。用户只需用自然语言向机器人发出指令,如“挂衣服”,GO-1就能根据所学习的知识和经验,拆解任务步骤并精准执行。这一过程中,GO-1不仅利用了互联网的大规模纯文本和图文数据来理解指令含义,还通过人类操作视频和仿真数据来学习动作模式和增强泛化性。

在实际应用中,GO-1展现出了惊人的适应性和灵活性。无论是家庭场景中的准备餐食、收拾桌面等任务,还是办公和商业场景中的接待访客、发放物品等工作,GO-1都能轻松应对。更令人兴奋的是,它还能通过数据回流系统持续进化学习,不断提升自身性能。例如,当机器人在制作咖啡时不小心将杯子放歪时,它就能从这次失败中吸取教训,并在后续任务中避免类似错误。

智元启元大模型GO-1的成功发布,不仅为机器人技术的发展注入了新的活力,也为人类生活带来了更多便利和可能性。随着具身智能技术的不断进步和应用场景的不断拓展,我们有理由相信,未来的机器人将更加智能、灵活和人性化。