在机器人技术领域的最新突破中,智元机器人公司于近日震撼发布了其首个通用具身基座模型——智元启元大模型Genie Operator-1(简称GO-1)。这一创新成果不仅标志着机器人智能化进程的一大步,还预示着具身智能正加速向通用化、开放化与智能化迈进。

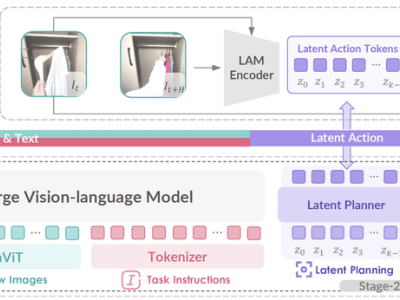

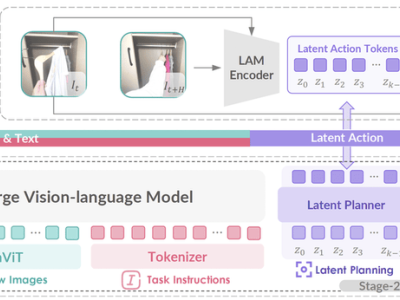

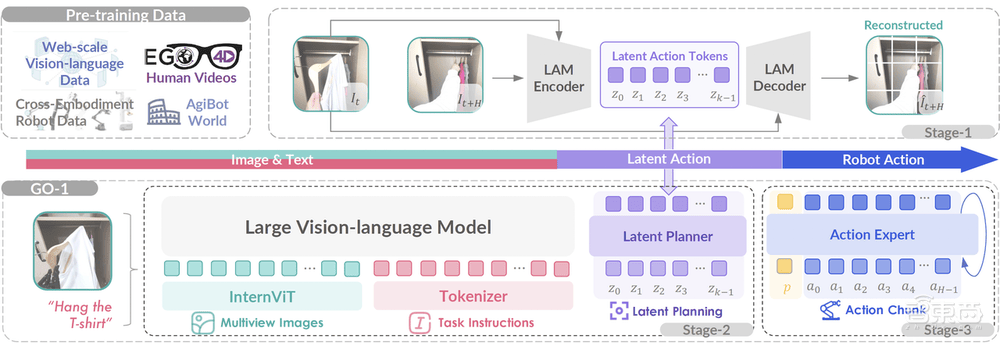

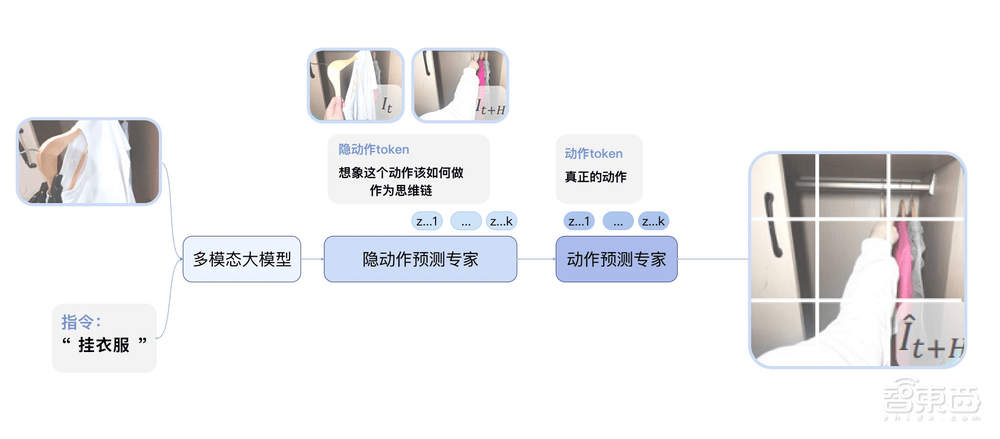

GO-1的核心在于其提出的Vision-Language-Latent-Action(ViLLA)框架,该框架巧妙融合了VLM(多模态大模型)与MoE(混合专家)技术,实现了从数据采集、模型训练到模型推理的无缝衔接。这一设计赋予了GO-1诸多显著优势,如小样本快速泛化能力、跨本体应用的“一脑多形”特性、持续进化的学习机制以及基于人类视频的学习能力。

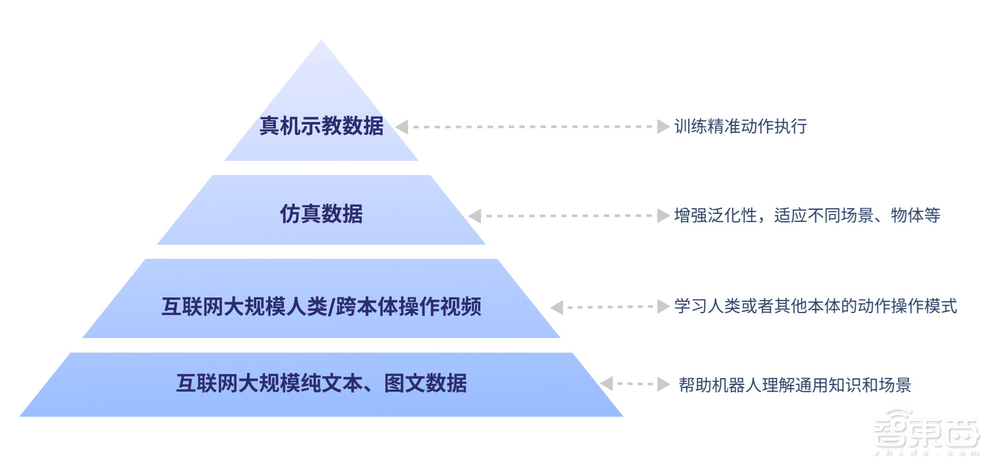

VLM作为GO-1的主干网络,通过继承开源多模态大模型的权重,并利用互联网上的大规模纯文本和图文数据,使得GO-1拥有了强大的场景感知和理解能力。而MoE中的隐动作专家模型和动作专家模型,则分别通过学习互联网上的大规模人类操作和跨本体操作视频,以及高质量的仿真数据和真机数据,让GO-1具备了动作的理解和精细执行能力。

GO-1的五大特点尤为引人注目:采训推一体的软硬件一体化框架,确保了从数据采集到模型推理的高效衔接;小样本快速泛化能力,使得GO-1能够在极少数据甚至零样本下快速适应新场景和新任务;一脑多形的特性,让GO-1能够在不同机器人形态之间灵活迁移,快速适配到各种本体;持续进化的学习机制,借助智元的数据回流系统,让GO-1能够从实际执行中遇到的问题数据中不断学习和进化;人类视频学习能力,则进一步增强了GO-1对人类行为的理解。

GO-1的构建基于具身领域的数字金字塔模型,从底层的互联网大规模纯文本与图文数据,到上层的互联网大规模人类操作/跨本体视频,再到仿真数据和高质量的真机示教数据,每一层都为GO-1提供了全面而丰富的知识和能力培训。这使得GO-1能够轻松面对多种多样的环境和物体,快速学习新的操作,并天然适应新的场景。

在实际应用中,GO-1的表现同样令人瞩目。用户只需用平常讲话的方式告诉机器人要做的事情,比如“挂衣服”,GO-1就能根据看到的画面和所学习的知识,理解任务要求,并拆解成一系列步骤来执行。从家庭场景中的准备餐食、收拾桌面,到办公和商业场景中的接待访客、发放物品,再到工业等更多场景的其他操作任务,GO-1都能快速而准确地完成。

GO-1的持续进化能力也值得称道。比如,在机器人做咖啡时,如果不小心把杯子放歪了,GO-1就能从这个问题数据中持续学习和进化,直到成功完成任务。这种不断学习和进步的能力,让GO-1在面对多变的真实世界时更加游刃有余。

智元机器人的这一创新成果,无疑为机器人技术的发展注入了新的活力。GO-1的出现,不仅解决了具身智能在场景和物体泛化能力不足、语言理解能力缺失、新技能学习缓慢以及跨本体部署困难等方面的问题,更为机器人代替人类完成工作生活中的各种事情提供了强大的脑力支持。未来,随着GO-1的不断优化和升级,我们有理由相信,机器人将走向更多不同场景,适应多变的真实世界,为人类的生活和工作带来更多便利和惊喜。