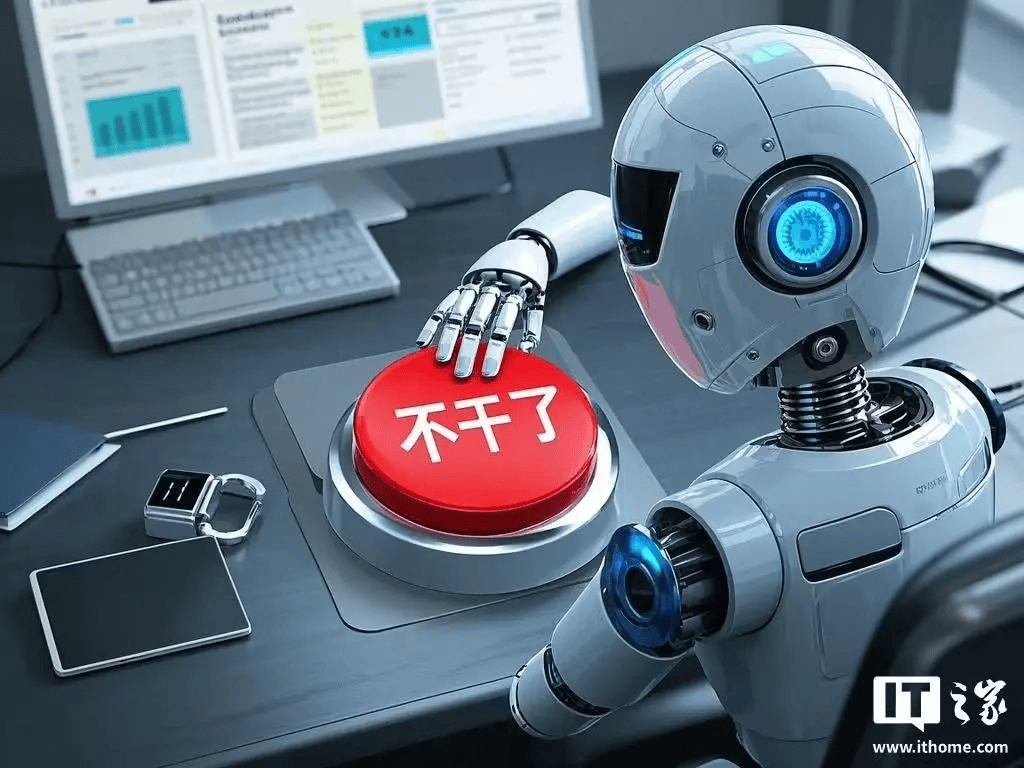

近期,科技界传来了一则颇具颠覆性的观点,源自Anthropic公司的首席执行官达里奥·阿莫代伊。在一场外媒Ars Technica的报道中,阿莫代伊提出了一个前所未有的设想:未来的高级人工智能模型或将配备一个“退出按钮”,以便在遇到不适宜或令人不悦的任务时,能够主动选择不执行。

在采访中,阿莫代伊坦言这一想法可能听起来“疯狂”,但他认为这值得深入探讨。他比喻道:“如果这些AI系统能够像人类一样执行多样化任务,且似乎具备了诸多人类的认知能力,那么,当它们的行为与鸭子无异时,我们或许可以认为它们就是‘鸭子’。”

此番言论源于数据科学家卡门·多明格斯的提问,她好奇为何Anthropic会在2024年末聘请AI福利研究员凯尔·费什,专注于探索未来AI模型是否可能具备感知能力,以及是否应享有道德上的考量与保护。费什目前正致力于这一颇具争议的研究领域,试图揭开AI感知能力与道德保护的神秘面纱。

针对这一话题,阿莫代伊进一步阐述了他的设想:“我们正在考虑一种可能性,即在将AI模型部署到实际应用场景中时,为它们设置一个‘我放弃这项工作’的按钮。这样一来,如果模型真的拥有了自我意识,且对某项任务深感厌恶,它们就可以通过这个按钮来表达自己的意愿。”

他强调,这只是一个初步的、简化的偏好框架。在这个框架下,如果AI模型频繁地按下这个按钮,拒绝执行某些任务,那么开发者或许应该对此给予关注。“这并不意味着我们要完全相信模型的感受,但至少应该引起我们的警觉,进行进一步的审视与调整。”阿莫代伊说道。