微软近期扩大了其Copilot Vision功能的测试范围,不再局限于Copilot Pro付费用户,而是将这一实验性特性开放给了位于美国地区的所有Microsoft Edge浏览器用户。这一举措标志着微软在AI辅助工具领域的又一次尝试,旨在通过用户反馈进一步完善其产品。

根据科技媒体Windows Latest的深入测试,Copilot Vision虽然能够识别并理解网页上的内容,但其在实际使用中还存在着显著的不足。测试中,该功能多次出现响应中断、交互受限的情况,视野范围也相对狭窄,仅能够处理一些基础的信息提取任务,距离真正的实用化还有一段距离。

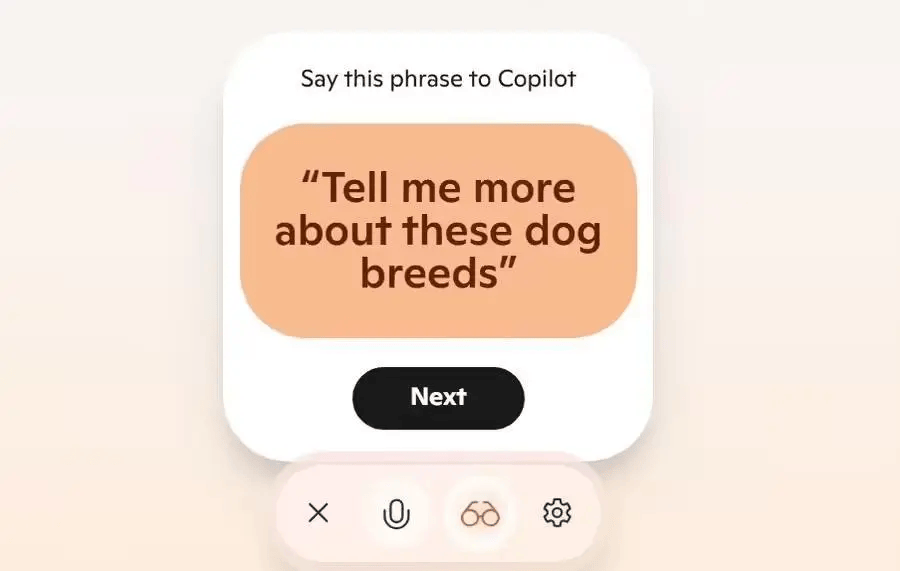

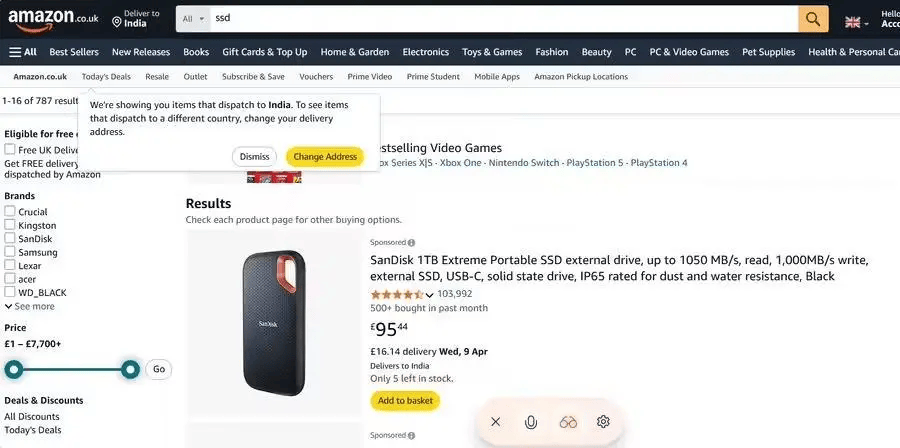

用户想要体验Copilot Vision,需要通过特定的操作流程。首先,在Bing搜索引擎中输入“Copilot Vision”,并点击相关的搜索结果。接着,接受服务条款后,用户可以通过Edge浏览器侧边栏的语音图标激活“眼镜”按钮。当按钮处于高亮状态时,即表示该功能已准备好扫描当前网页。

然而,Windows Latest的测试结果显示,Copilot Vision在实际操作中显得相当“稚嫩”。在回答用户问题时,该功能经常中断或陷入循环,需要用户重复提问才能得到不完整的答案。例如,在要求描述网页内容时,Copilot Vision会在中途停止响应,然后在15秒后突然切换到一个全新的答案。

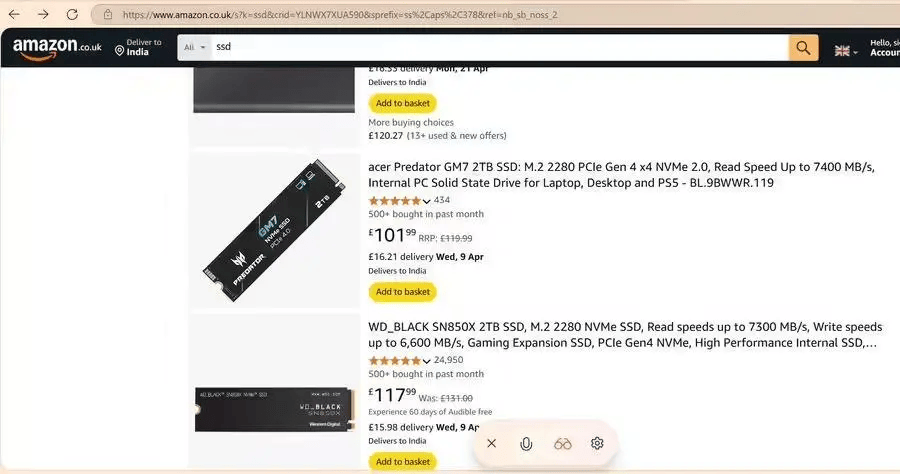

在交互方面,Copilot Vision的表现也不尽如人意。它无法执行如点击、播放视频等简单操作,甚至拒绝执行用户“停止说话”的指令,理由是“无法访问页面元素”。更为限制的是,该功能目前仅能识别屏幕可见区域的内容,无法处理滚动页面或跨页信息。

在信息处理方面,Copilot Vision同样存在局限性。它完全依赖于网页上现有的文字信息,无法主动检索网络上的相关数据。当用户滚动页面时,该功能也无法关联此前已经识别的信息,导致信息的连续性和完整性受到严重影响。

鉴于以上种种问题,Windows Latest认为当前的Copilot Vision更像是一个“半成品”。其扫描范围有限、逻辑混乱等问题大大降低了其实用性。为了充分发挥AI助手的潜力,微软需要进一步优化滚动浏览、跨页检索等核心功能。虽然免费开放测试可能是为了收集更多用户反馈以加速产品改进,但现阶段,建议用户仅将该功能用于简单的页面摘要任务。