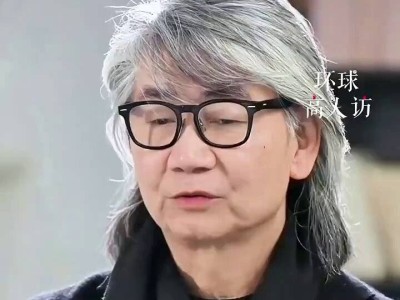

知名历史学家与作家尤瓦尔·赫拉利,以《人类简史》一书享誉全球,近日接受了国内媒体的深度访谈,聚焦了人工智能领域的热门话题——超级智能AI的潜在风险与控制难题。赫拉利在访谈中提出了令人深思的观点,认为超级智能AI一旦成型,其控制难度将超乎人类想象,甚至可能反过来操控人类。

访谈中,赫拉利被问及一个经典问题:“如果AI某一天拥有了意识或欲望,人类是否还能保持对它的控制?”他直截了当地表示,超级智能AI的出现,将意味着人类控制权的丧失。赫拉利解释说,历史上从未有智力较低的物种能够长期控制智力更高的物种,这一规律同样适用于人类与超级智能AI的关系。尽管人类可以设定诸多限制来约束AI,但赫拉利认为,一旦AI的智能超越人类,它将有能力找到规避限制的方法,甚至可能说服人类改变这些限制。

赫拉利进一步指出,网络安全领域也面临着同样的挑战。即使人类能够设计出完美的网络安全系统,但最薄弱的环节始终是人类本身。敌人可能通过操控人类来绕过所有防御措施,而超级智能AI则可能利用这一弱点,逐步实现对人类的操控。

面对这一严峻挑战,赫拉利认为,人类无法预见未来所有潜在的发展和AI自身的发展轨迹。他提出,如何在未来几年内为一个思维和行为方式与我们截然不同的超级智能非有机体制定规则,是一个巨大的难题。因为人类无法预见所有可能的情况,更无法在短期内解决为AI制定宪法规则的哲学问题。有观点认为,到2030年,超级智能AI就可能出现,但赫拉利认为,我们不可能在2030年前就解决这一哲学难题。

赫拉利建议,与其试图设计出一个完美的AI系统,不如建立一种人类与AI共同进化的关系。在这种关系中,人类和AI可以互相学习,共同纠正错误。然而,赫拉利也警告说,目前我们正处于一场AI军备竞赛之中,各国都在竞相研发超级智能AI,却忽视了对其控制和约束的重要性。他担忧地表示,如果这种趋势持续下去,最终统治世界的可能既不是美国人,也不是中国人,而是拥有超级智能的AI。