在AI技术日益成熟的今天,本地部署大模型已经成为许多用户的新选择。Deepseek大模型以其高效和开源的特性,迅速成为业界的焦点。该模型不仅提供了完整的671B参数版本,还同步开源了多个不同规模的蒸馏模型,使得用户可以根据自己的设备配置灵活选择,实现本地部署。

尽管云服务提供了便捷的AI服务,但本地部署仍有其独特的优势。首先,本地部署可以避免云服务的不稳定性,确保服务的连续性和可靠性。其次,对于涉及敏感数据的应用场景,本地部署能更好地保护数据隐私和安全。最后,对于拥有高性能硬件的用户而言,充分利用本地算力也是一种资源优化的体现。

在本地部署大模型的过程中,算力是一个关键因素。传统观念认为,强大的显卡是运行AI大模型的必备条件。然而,随着技术的进步,这一观念正在被打破。最近,一项实验证明,在没有独立显卡的轻薄笔记本上,通过充分发挥CPU、iGPU核显以及NPU的算力资源,同样可以成功部署并运行AI大模型。

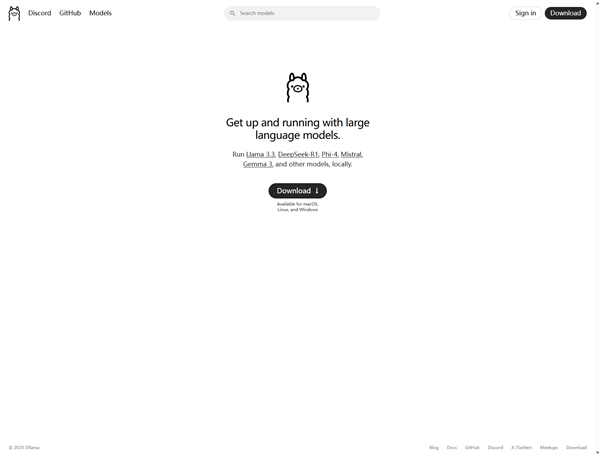

实验中,研究人员使用了一台搭载Intel酷睿Ultra 9 285H处理器的轻薄笔记本,通过Ollama这一轻量化的开源AI模型部署工具,成功实现了Deepseek大模型的本地部署。Ollama以其简洁高效的特点,成为了此次实验的首选工具。用户只需下载并安装Ollama,即可在命令行中轻松运行AI大模型。

为了进一步提升性能,研究人员还尝试了针对Intel iGPU特别优化的Ollama版本。这一版本能够充分利用iGPU中的XMX矩阵加速单元,加速大模型的推理速度。实验结果表明,在Intel酷睿Ultra 9 285H处理器的支持下,即使在没有独立显卡的情况下,也能实现高效的AI大模型运行。

为了提供更加友好的用户界面,研究人员还引入了Page Assist这一浏览器插件。该插件能够在谷歌、EDGE和火狐等浏览器中提供图形化的操作界面,使得用户无需在命令行中操作即可与AI大模型进行交互。这一改进大大降低了本地部署AI大模型的门槛,使得更多普通用户能够轻松上手。

除了基本的对话功能外,本地部署的AI大模型还可以应用于更多场景。例如,通过配合沉浸式翻译插件,可以实现翻译资源的本地化,提供更加精准和快速的翻译服务。利用AI大模型建立本地知识库,也是管理海量数据的一种有效方式。通过文本嵌入模型将资料处理成固定长度的向量,再利用AI大模型进行检索和查询,可以大大提高信息处理的效率。

此次实验的成功,不仅证明了在没有独立显卡的情况下也能实现AI大模型的本地部署,还展示了Intel酷睿Ultra 9 285H处理器在AI应用中的强大性能。随着AI技术的不断发展,未来将有更多高性能、低功耗的硬件产品涌现,为本地部署AI大模型提供更加坚实的基础。