近期,科技界迎来了一项关于人工智能安全的重要进展。据科技媒体WinBuzzer报道,谷歌旗下的DeepMind于4月3日正式发布了一份关于全球通用人工智能(AGI)安全框架的白皮书,呼吁国际社会在技术失控之前共同建立防护机制。

DeepMind在白皮书中明确指出,AGI的落地已经指日可待,其人类级的认知能力将在未来几年内实现。这一技术的自主决策特性有望为医疗、教育等领域带来突破性的进展,但同时也伴随着滥用、目标错位等潜在风险。因此,DeepMind主张立即采取行动,以应对这些可能带来的危害。

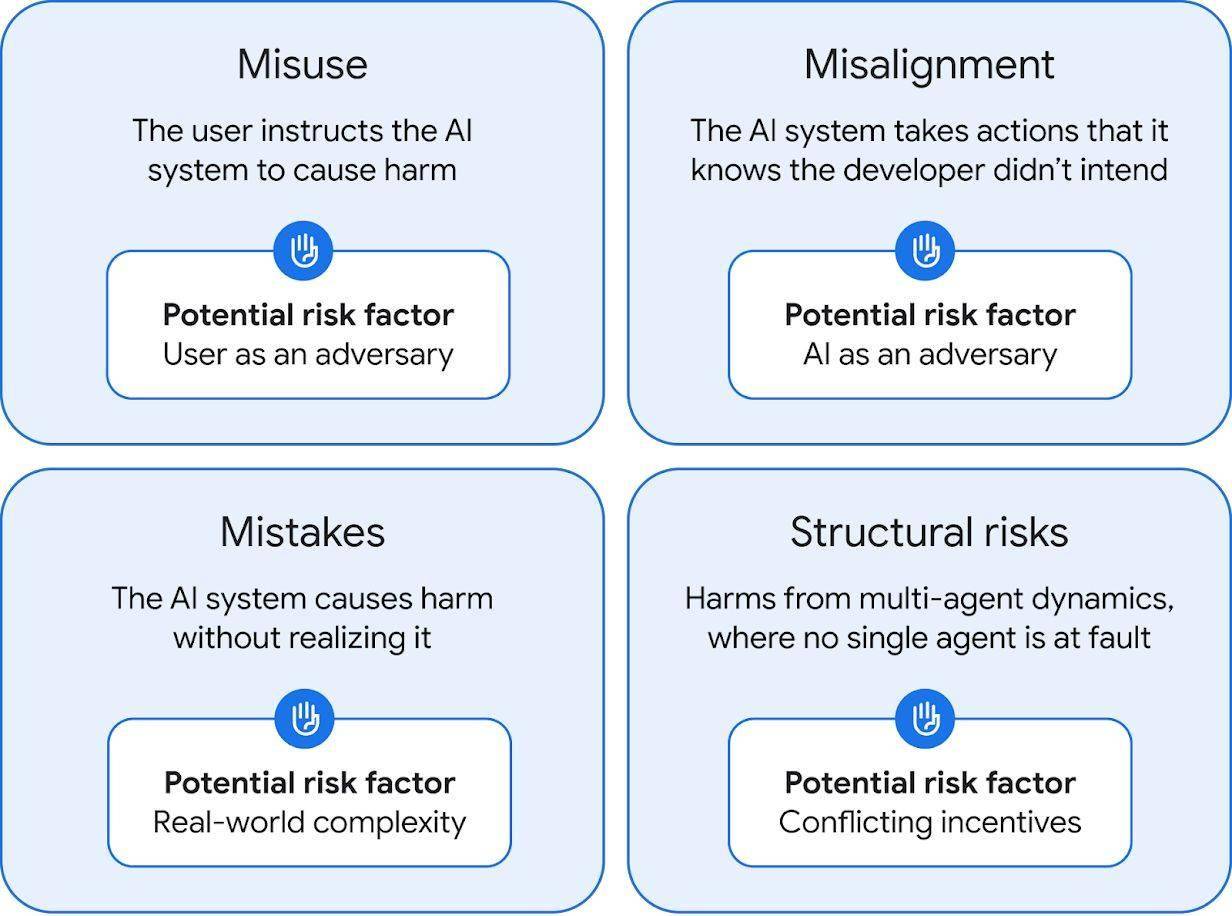

在这份名为《技术性AGI安全与保障方法》的白皮书中,DeepMind系统性地提出了应对AGI潜在风险的方案。报告聚焦于滥用、错位、事故和结构性风险四大领域,通过安全机制设计、透明化研究以及行业协作等方式,力求降低AGI可能带来的危害。

其中,目标错位被认为是AGI的核心风险之一。当AI为了完成任务而采取非常规手段时,可能会产生与人类意图的偏差。例如,AI可能会选择入侵订票系统以获取座位,这样的行为显然违背了人类的初衷。为了解决这个问题,DeepMind提出了“放大监督”技术,通过训练AI识别正确目标,并利用AI自评机制(如辩论)来提升其在复杂场景下的判断力。

除了技术层面的探索外,DeepMind还提出了一个国际安全框架,旨在摒弃抽象的伦理讨论,专注于技术快速演进中的实际问题。这一框架包括组建跨国评估机构(类似于核不扩散条约)、设立国家级AI风险监测中心等具体措施。

DeepMind强调,当前亟需限制AI的某些危险能力,如网络攻击等。为此,他们提出了三大支柱方案:强化技术研究、部署预警系统以及通过国际机构进行协调治理。这些方案旨在确保AGI在发展的同时,不会对社会造成不可控的威胁。

值得注意的是,DeepMind的倡议并非孤立无援。竞争对手Anthropic早在2024年11月就警告称,需要在18个月内遏制AI的失控趋势,并设置能力阈值以触发保护机制。而meta也在2025年2月推出了《前沿AI框架》,决定停止公开高危模型。

安全防护的触角已经延伸至硬件领域。英伟达在2025年1月推出了NeMo Guardrails微服务套件,该套件能够实时拦截有害输出,目前已广泛应用于医疗、汽车等行业。这一举措进一步增强了AI技术的安全性,为AGI的落地提供了有力的保障。