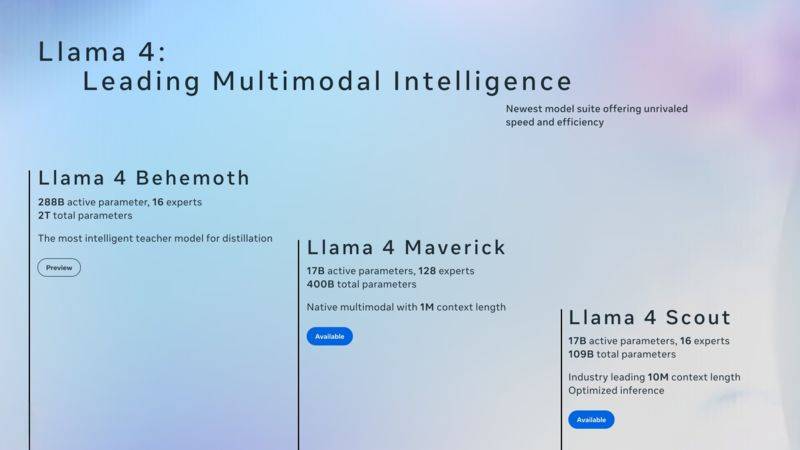

meta公司近期震撼发布了其全新的Llama 4系列人工智能模型,该系列包括Llama 4 Scout、Llama 4 Maverick及尚未完全公开的Llama 4 Behemoth,标志着AI技术的新里程碑。

此次发布的亮点在于Llama 4系列首次引入了混合专家(MoE)架构,这一创新设计通过将复杂任务分解给多个专业子模型处理,极大提升了模型训练和推理的效率。这些“专家”子模型各司其职,共同协作,使得Llama 4系列在处理多任务时更加游刃有余。

值得注意的是,Llama 4系列模型经过海量多模态数据的严格训练,包括文本、图像、视频和音频等多种格式,因此具备了出色的视觉理解和跨格式内容转换能力。这种全面的数据处理能力,使得Llama 4系列在多媒体应用中展现出无与伦比的优势。

在上下文处理能力方面,Llama 4系列同样令人瞩目。特别是Llama 4 Scout,其上下文窗口高达1000万个token,而Llama 4 Maverick也达到了100万个token。这意味着它们可以轻松应对超长文本输入,如7500页的文档,为科研、工程、文学等领域提供了前所未有的支持。

目前,用户已经可以在Llama.com网站以及meta旗下的WhatsApp、Messenger、Instagram Direct等平台体验到Llama 4 Scout和Llama 4 Maverick的强大功能。据meta透露,Llama 4 Behemoth仍在紧锣密鼓的训练中,预计将在未来某个时间点与大家见面。

具体来看,Llama 4 Scout凭借其170亿活跃参数和16个“专家”模型(总参数达1090亿),在文档总结和代码推理方面表现出色,且仅需单个NVIDIA H100 GPU即可运行,非常适合高效信息提取和复杂逻辑推理任务。而Llama 4 Maverick则拥有更庞大的170亿活跃参数和128个“专家”模型(总参数量高达4000亿),在创意写作、翻译和图像处理等方面均展现出卓越性能,超越了众多竞争对手。

至于Llama 4 Behemoth,作为系列中的旗舰产品,它配备了惊人的2880亿活跃参数和接近2万亿的总参数,使其在多个STEM基准测试中独占鳌头,充分证明了其强大的问题解决能力。