在AI技术逐步迈向实际应用场景的转折时期,市场正密切关注如何构建一个高效、敏捷且体验一致的智能生态系统。联发科于2025年的天玑开发者大会上,以“AI随芯,应用无界”为主题,吸引了全球范围内的终端制造商与开发者,共同探讨了智能生态的未来方向。会上,联发科提出了“智能体化用户体验”的战略构想,并启动了旨在引领这一趋势的“天玑智能体化体验领航计划”。

联发科提出的“智能体化用户体验”包含了五大核心特征:主动及时、深度理解用户、互动协作、持续学习进化以及专属隐私保护。这些特征的实现,需要跨越从芯片设计到终端应用,乃至整个生态系统的全面革新,同时离不开高效且强大的开发者解决方案。为此,联发科推出了一站式可视化智能开发工具——天玑开发工具集,以及全新升级的天玑AI开发套件2.0。

天玑开发工具集中的Neuron Studio,是一款专为AI应用开发设计的一站式、全链路开发工具。它解决了开发者在AI应用开发过程中面临的三大痛点:工具碎片化、调优过程繁琐以及模型分析效率低下。Neuron Studio通过整合多个MLKits工具,包括模型转换、量化和调优,实现了从模型到应用的全流程自动化开发。开发者无需再频繁切换多个工具链,只需一套工具即可完成全部开发工作,显著提升了开发效率。

Neuron Studio还支持神经网络自动化调优和跨模型全链路分析功能。它能够根据开发需求,自动优化性能和内存占用,使开发者能够全程监控大模型的演化过程,大幅缩短了调优时间。同时,跨模型全链路分析功能为开发者提供了全局视角和执行流程,大大节省了模型分析时间。

天玑AI开发套件2.0则在模型库规模、架构开放程度、前沿技术支持以及端侧LoRA训练等方面实现了全面升级。Gen-AI Model Hub的模型数量激增3.3倍,支持多种先进端侧大模型,为开发者提供了更丰富的模型选择。联发科还首发了开源弹性架构,允许开发者直接调整平台源代码,无需等待芯片厂商支持即可完成自研大模型的部署,彻底释放了开发效率和模型接入自由度。

天玑AI开发套件2.0还支持DeepSeek的四大关键技术,包括混合专家模型(MoE)、多Token预测(MTP)、多头潜在注意力(MLA)和FP8推理(FP8 Inferencing),这些技术使端侧AI推理更聪明、响应更迅速。同时,天玑AI开发套件2.0首次引入基于NPU的端侧LoRA训练,相比基于CPU的训练方案,训练速度提升了50倍,使端侧AI能够基于用户数据提供更加个性化的体验。

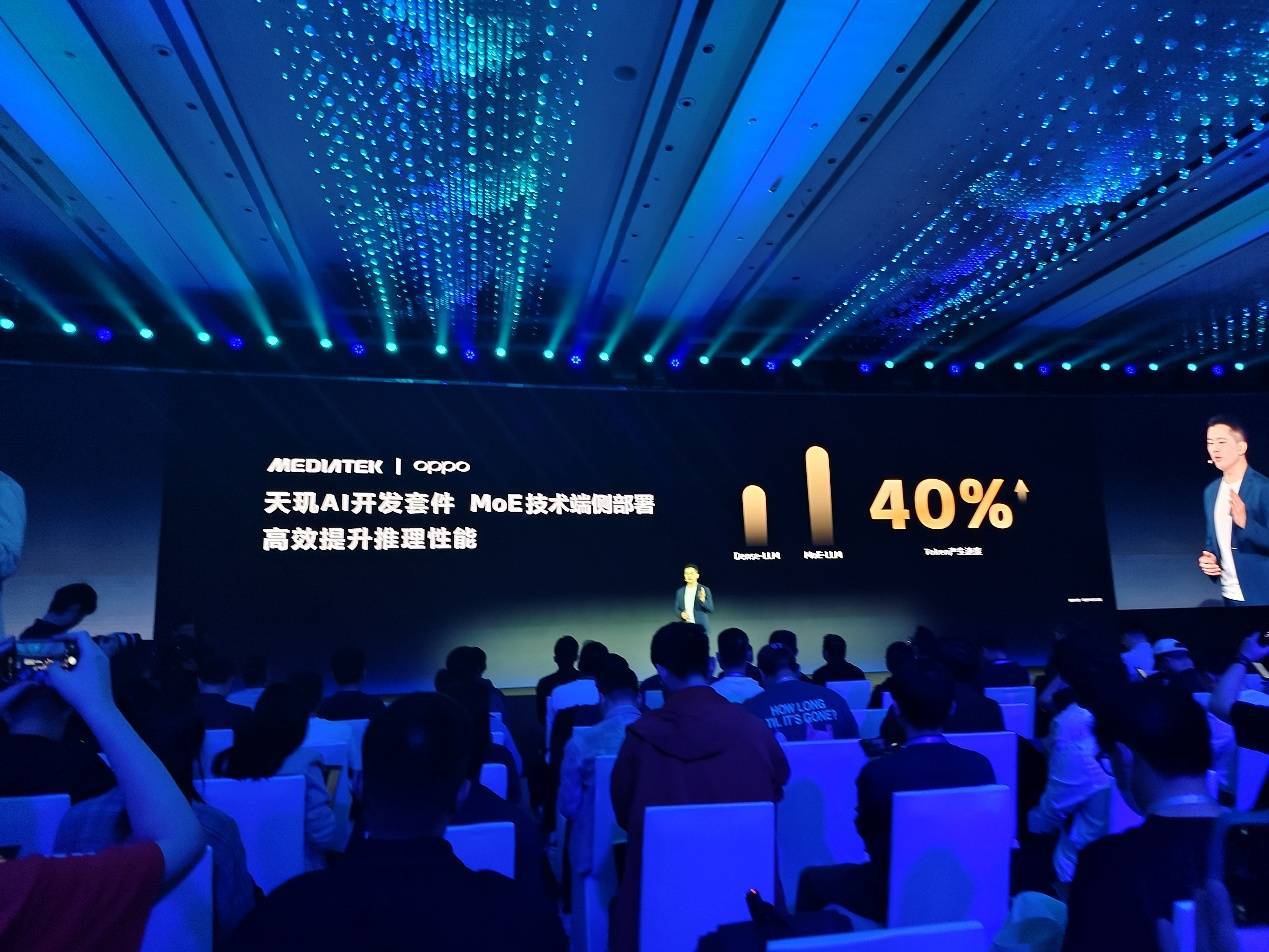

联发科还展示了不断拓展的天玑AI生态。自去年以来,天玑AI生态伙伴数量大幅增长,天玑AI开发套件下载量也同比增长了5倍。联发科与OPPO、vivo、全民K歌以及美图等企业展开了深度合作,共同研发了一系列基于天玑AI技术的创新应用。例如,联发科与OPPO合作,借助天玑AI开发套件中的DeepSeek技术,实现了MoE技术的端侧部署,大幅提升了端侧大模型的计算效率和推理性能。联发科还与vivo和全民K歌合作,推出了安卓首款K歌旗舰手机vivo X200s,该手机借助天玑AI人声萃取技术,提供了录音室级的K歌体验。

在智能座舱领域,联发科与绝影合作,快速完成了绝影自有模型的移植,使首字词生态速度比云端方案提升了70%,为绝影多模态智能座舱提供了强大的端侧运行能力。天玑AI开发套件已经接入NVIDIA TAO生态圈,实现了两大生态的全面打通,为开发者提供了更多的AI开发资源和更广泛的应用场景。

联发科通过“芯-模-端”三元联动路径,将芯片算力、开发工具和终端应用打通,形成了智能体化用户体验的底层重构。这一变革不仅关乎产品形态的革新,更是产业链协作模式的升级前兆。联发科的角色正在从AI能力提供者转变为智能体验的生态推动者,为智能体化AI体验时代的到来按下了加速键。