阿里云近期宣布了一项重大进展,正式推出了其最新的Qwen3系列混合推理模型,并慷慨地决定将这8款模型全部开源。这一举措为全球的开发者、研究机构及企业提供了前所未有的机遇,使他们能够免费获取并利用这些先进的模型。

Qwen3系列中包含了两款引人注目的MoE模型:Qwen3-235B-A22B和Qwen3-30B-A3B。前者拥有超过2350亿的总参数和220多亿的激活参数,而后者则以300亿的总参数和30亿的激活参数展现其独特魅力。还有六个Dense模型,它们分别是Qwen3-32B、Qwen3-14B、Qwen3-8B、Qwen3-4B、Qwen3-1.7B和Qwen3-0.6B,各自在性能和规模上满足不同需求。

这些模型不仅可以在魔搭社区和HuggingFace等平台上自由下载,还完全支持Apache2.0协议,允许商业使用。阿里云还提供了额外的便利,用户可以通过其百炼平台直接调用Qwen3的API服务。对于个人用户,通义APP已经准备好让用户体验Qwen3的强大功能,而夸克也即将全面集成这一系列的模型。

Qwen3模型在支持的语言和方言上同样表现出色,覆盖了多达119种,极大地方便了全球各地的用户。更为先进的是,Qwen3还提供了两种思考模式,一种是适合复杂问题的“思考模式”,另一种是面向简单问题、更注重速度的“非思考模式”。这种设计使得用户可以根据实际需求调整模型的“思考”程度,从而在成本和推理质量之间找到最佳平衡点。

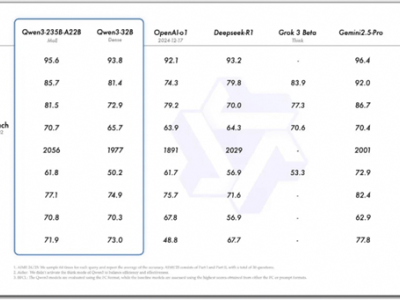

在性能表现上,旗舰模型Qwen3-235B-A22B在多项基准测试中展现出了与顶级模型相媲美的实力,甚至在某些方面超越了OpenAI-o1和DeepSeek-R1等大模型。而小型MoE模型Qwen3-30B-A3B,尽管其激活参数仅为QwQ-32B的10%,但其表现却更为出色。即便是像Qwen3-4B这样的小型模型,其性能也能与Qwen2.5-72B-Instruct相抗衡。

在部署方面,阿里云推荐使用SGLang和vLLM等框架,这些框架能够高效地利用Qwen3模型的能力。对于希望在本地使用这些模型的用户,阿里云也推荐了一系列工具,如Ollama、LMStudio、MLX、llama.cpp和KTransformers,它们都能为用户提供便捷的使用体验。